Ảnh: Minh họa

Tuy nhiên đi kèm với sự phát triển tưởng chừng như vượt bật này là những vấn đề pháp lý và rủi ro liên quan đến xã hội như quyền tác giả, việc quản lý và kiểm soát AI, vấn đề vi phạm bảo mật thông tin và các tiêu chuẩn an toàn của trí tuệ nhân tạo AI. Có thể thấy rằng pháp luật hiện nay còn thiếu các biện pháp cần thiết để ngăn ngừa những rủi ro đến từ AI qua bàn tay sử dụng của con người,

Mặc dù hiện nay việc phát triển AI tại Việt Nam còn bị nhiều hạn chế về nguồn vốn, nhân lực chuyên môn và sự đầu tư một cách hệ thống về cơ sở hạ tầng công nghệ. Tác giả tin rằng sự phát triển và ứng dụng của công nghệ trí tuệ nhân tạo AI tại Việt Nam trong tương lai là điều không thể tránh khỏi. Do đó ta cần phải chuẩn bị sẵn một hành lang pháp lý để quản lý và kích thích cho sự phát triển của ngành trí tuệ nhận tạo AI trong Việt Nam đồng thời giảm thiểu các rủi ro và khó khăn từ việc ứng dụng và sử dụng AI trong công cuộc xây dựng và phát triển đất nước của Việt Nam chúng ta.

Do vậy để chuẩn bị cho hành lang pháp lý này 1 cách vững chắc, tác giả tin rằng chúng ta cần nhanh chóng có được góc nhìn tổng quát thông qua việc quan sát cách tiếp cận của một số quốc gia trong vấn đề pháp lý và chính sách đối với công nghệ trí tuệ nhân tạo AI hiện nay. Qua đó rút ra bài học và kinh nghiệm quý giá cho pháp luật Việt Nam trên con đường quản lý và ứng dụng công nghệ trí tuệ nhân tạo AI trong tương lai.

Sự cần thiết về lý luận cũng như tính cấp thiết về mặt thực tiễn chính là lý do mà tác giả chọn đề tài “Trí tuệ nhân tạo AI – Góc nhìn từ luật của các nước và những bài học trong tương lai cho Việt Nam” .

1. Tình hình nghiên cứu của đề tài:

Sự phát triển của trí tuệ nhân tạo đang trở thành tâm điểm chú ý của xã hội. Hiện nay đã có nhiều nước đã đẩy mạnh với việc đưa ra các quy tắc và điều lệ đề cập và hướng dẫn đối với công nghệ trí tuệ nhân tạo AI với trọng tâm là tạo ra mô hình để quản lý công nghệ mới này một cách hiệu quả hơn, đồng thời khuyến khích sự phát triển của trí tuệ nhân tạo AI. Để làm được điều này, nhiều nước đã chọn các tiếp cận với các biện pháp khác nhau. Ví dụ như liên minh EU đã chọn việc quản lý bằng cách xây dựng nên một bộ luật riêng và chung cho trí tuệ nhân tạo AI, Singapore chú tâm về sự phát triển với các chính sách tập trung vào việc khuyến khích các công trình nghiên cứu và ứng dụng AI của các công ty vào mô hình quản lý và phát triển sản phẩm. Còn đối với nước Trung Quốc, một đất nước đề cao về quản lý xã hội tập trung chính sách của họ vào việc quản lý theo mô hình nhắm vào việc xử lý các hành vi đồng thời tạo ra các quy tắc tùy chỉnh nhắm vào các vấn đề cụ thể.

Có thể nói rằng công nghệ trí tuệ nhân tạo AI vẫn còn là một ngôn ngữ rất xa lạ trong pháp luật. Tuy nhiên điều đó vẫn không ngăn cản chính quyền đưa ra các chính sách một cách nhanh chóng để quản lý công nghệ mới. Tính tới thời điểm hiện tại là 25/3/2024 chúng ta đã có rất nhiều văn bản hướng dẫn nói lên các hướng đi của chính quyền nước ngoài trong phạm vi nghiên cứu để làm nguồn cho việc phân tích công việc quản lý trí tuệ nhân tạo AI của các nước đó trong tương lai. Bao gồm:

- Luật AI của liên minh Châu Âu

- Các biện pháp tạm thời và các bộ luật liên quan đến quản lý AI của các nước

- Đề xuất hướng dẫn và tư vấn của chính phủ các nước về AI

- Các bộ luật liên quan đến các hoạt động của AI

- Một số ấn phẩm và sách trắng liên quan đến AI cho các cơ quan chính phủ tổ chức và ban hành

- Các báo, tạp chí có bài viết liên quan đến góc nhìn của chính phủ của các nước đối với AI

- Các biện pháp tạm thời để quản lý dịch vụ trí tuệ nhân tạo do Cục Quản lý Không gian mạng Trung Quốc cùng với sáu cơ quan chính phủ khác của chính phủ đất nước Trung Quốc

- Luật bảo mật dữ liệu và luật bảo vệ thông tin cá nhân của Trung Quốc

- Đề xuất hướng dẫn và tư vấn về sử dụng cá nhân trong AI được xuất bản bởi ủy ban bảo vệ dữ liệu cá nhân Singapore

2. Phạm vi và mục đích nghiên cứu

Đề tài hi vọng mang lại cái nhìn tổng quan hơn về sự tiếp cận và góc nhìn của 1 số nước đối với trí tuệ nhân tạo thông qua việc phân tích một số mô hình pháp luật của các nước (Trung Quốc, liên minh EU và Singapore) từ đó rút ra những kinh nghiệm quý giá cho hành lang của luật pháp Việt Nam trong tương lai.

Để có tầm nhìn toàn diện về một vấn đề thì cần phải tìm hiểu phân tích cặn kẽ mọi mặt của vấn đề đó. Tuy nhiên, tác giả sẽ không đi sâu vào việc giải thích sự vận hành, phát triển và áp dụng trí tuệ nhân tạo AI của các nước khác. Công việc này sẽ dành cho những nhà khoa học và quản lý công nghệ kĩ thuật.

Trong đề tài này, tác giả sẽ tập trung nghiên cứu những khía cạnh, lý luận và các hành động thể hiện việc quản lý của một số nước trong phạm vi nghiên cứu đối với công nghệ trí tuệ nhân tạo AI thông qua việc phân tích hồ sơ và thông tin của chính quyền về hệ thống pháp lý đối với trí tuệ nhân tạo AI tính từ ngày 25 tháng 3 năm 2024. Đồng thời tác giả cũng sẽ tìm hiểu và phân tích cách thức để xây dựng một hành lang pháp lý phù hợp với sự phát triển, giảm thiểu các rủi ro và khó khăn từ việc ứng dụng AI đối với Việt Nam trong tương lai qua cách thức tiếp cận của một số nước trên thế giới theo tác giả đã chọn là Trung Quốc, liên minh EU và Singapore.

3. Phương pháp nghiên cứu

Cơ sở phương pháp luận : Để đạt được mục đích đề ra, trong quá trình nghiên cứu tác giả sử dụng phương pháp nghiên cứu: phân tích, chứng minh, biện luận, tổng hợp, đối chiếu và so sánh

4. Gía trị của đề tài

Khi nghiên cứu về việc tiếp cận của các nước về trí tuệ nhân tạo, tác giả mong muốn mang đến 1 cái nhìn tổng thể về thuận lợi cũng như khó khăn của việc phát triển và áp dụng trí tuệ nhân tạo AI đối với hành lang pháp lý của một số nước trên thế giới. Từ đó tác giả sẽ rút ra được bài học để chuẩn bị cho hành lang pháp lý một cách hợp lý đối với việc quản lý công nghệ trí tuệ nhân tạo. Đồng thời thúc đẩy sự phát triển, giảm thiểu các rủi ro và khó khăn từ việc ứng dụng AI trong tương lai.

Table of Contents

Chương 1: Tổng quan về trí tuệ nhân tạo AI và sự bùng nổ của ngành trí tuệ nhân tạo

1.1. Sự ra đời của trí tuệ nhân tạo và cột mốc phát triển vượt bật.

1.2 Khái niệm của trí tuệ nhân tạo và những ứng dụng liên quan

1.2.1 Khái niệm của trí tuệ nhân tạo và việc ứng dụng trí tuệ nhân tạo

1.2.2. Khái niệm của các công cụ ứng dụng của trí tuệ nhân tạo

1.2.3. Tình hình về pháp luật quản lý trí tuệ nhân tạo của các nước

1.2.4. Lý do lựa chọn các nước nghiên cứu của tác giả.

1.3. Các yếu tố và vấn đề cần thiết cho pháp luật về AI giữa nhà nước và doanh nghiệp

1.3.1. Các vấn đề pháp lý cần thiết để tạo nên một hành lang pháp lý hợp lý cho AI.

1.3.2. Các yếu tố cần thiết để có thể khuyến khích việc ứng dụng hợp lý cho doanh nghiệp

1.4. Các vấn đề vi phạm pháp luật đã và đang xảy ra do công nghệ trí tuệ nhân tạo.

1.4.1 Lạm dụng AI một cách ác ý: Lỗ hổng của các mô hình AI

1.4.2 Sử dụng AI có mục đích xấu: Các cuộc tấn công được kích hoạt bởi AI và được tăng cường bởi AI

Chương 2: Pháp luật quản lý AI ở nước ngoài – Thực trạng và tình hình quản lý

2.1. Đạo luật trí tuệ nhân tạo của EU

2.1.1. Tổng quan về Đạo luật AI của EU

2.1.2 Các điểm chú ý trong đạo luật

2.1.3 Tiến trình quản lý trong đạo luật trí tuệ nhân tạo của EU

2.1.3.1. Khái niệm và cách phân loại các hệ thống trí tuệ nhân tạo của đạo luật EU

2.1.3.2. Mô hình quản lý của đạo luật EU đối với các hệ thống trí tuệ nhân tạo

2.1.4. Quản lý và thực thi của Đạo Luật AI EU

2.1.5 Phân tích lợi thế và bất lợi thế đến từ đạo luật này.

2.2 Sơ lược về sự tiếp cận và quản lý của Trung Quốc đối với nước AI

2.2.1 Tình hình của Trung Quốc đối với AI

2.3. Tổng quan về pháp luật của Trung Quốc đối với AI

2.3.1. Kế hoạch tương lai của nước Trung Quốc đối với AI.

2.3.2 Tổng quan về pháp luật của Singapore đối với AI

2.4 Sơ lược về phương pháp tiếp cận, ứng dụng và quản lý của Singapore đối với các ứng dụng AI

2.4.1 Phân tích các quy định liên quan đến việc đánh giá AI của tổ chức AI Verify của Singapore

2.4.2. Hệ thống trí tuệ nhân tạo mô hình ngôn ngữ lớn (LLM) và mô hình đánh giá hệ thống.

2.4.4 Kế hoạch tương lai của nước Singapore đối với AI

Chương 3: Trí tuệ nhân tạo ở Việt Nam, thực trạng và phương hướng toàn diện

3.1. Trí tuệ nhân tạo ở Việt Nam.

3.2. Chiến lược của Việt Nam đối với việc nghiên cứu, phát triển và ứng dụng trí tuệ nhân tạo.

3.3 Bài học có được từ việc quan sát cách tiếp cận của các nước khác đối với việc quản lý AI

Chương 1: Tổng quan về trí tuệ nhân tạo AI và sự bùng nổ của ngành trí tuệ nhân tạo

Ít ai biết được rằng trí tuệ nhân tạo đã được bắt đầu quan tâm và nghiên cứu từ thập niên 1950 với việc ra đời của các mô hình lý thuyết ban đầu. Tuy nhiên sự phát triển của AI tại thời điểm đó đã nhanh chóng bị cản trở bởi các hạn chế về nguồn lực tính toán cũng như dữ liệu ,giới hạn các mô hình AI khiến chúng không đủ mạnh mẽ để giải quyết các vấn đề phức tạp. Việc giải quyết vấn đề này là một ẩn số cho đến khi mạng Internet ra đời. Với nguồn dữ liệu khổng lồ, Internet đã tạo ra cơ hội cho việc thu thập và chia sẻ dữ liệu với số lượng lớn, đóng vai trò quan trọng trong việc nâng cao hiệu suất của các hệ thống tự học khiến cho AI có khả năng học tập và tương tác với môi trường xung quanh.

Sự kết hợp giữa AI và các công nghệ khác như IoT (Internet of Things), blockchain, và Big Data đã mở ra nhiều cơ hội mới trong việc phát triển nhiều lĩnh vực như y tế, tự động hóa công nghiệp, dịch vụ tài chính. Tuy nhiên đi kèm với những vấn đề này là những vấn đề về việc vi phạm pháp luật đã được quy định sẵn từ trước như quyền tác giả, quyền con người, quyền thông tin hay những rủ ro tiềm ẩn như vấn đề quản lý và kiểm soát AI, sự thao túng xã hội bằng AI của con người , ngăn chặn việc lạm dụng AI của con người, bảo vệ các thông tin tuyệt mật và các tiêu chuẩn an toàn của AI.

Vậy các nước đã có những biện pháp, những chiến lược gì để đảm bảo cho sự phát triển của xã hội và giảm thiểu các rủi ro đến từ việc sử dụng AI ? Những yếu tố nào cần chú tâm ? những yếu tố nào có thể hợp nhất vào trong luật của Việt Nam để có thể vừa thúc đẩy sự phát triển của AI tại Việt Nam vừa đảm bảo sự an toàn ? Trả lời được những câu hỏi này sẽ giúp cho các đất nước Việt Nam ta tiến thêm 1 bước gần hơn trong công cuộc xây dựng thành công một hành lang pháp lý hiệu quả cho một môi trường phát triển và ứng dụng trí tuệ nhân tạo AI với mục tiệu hướng đến cao nhất là nâng cao chất lượng và phục vụ cộng đồng.

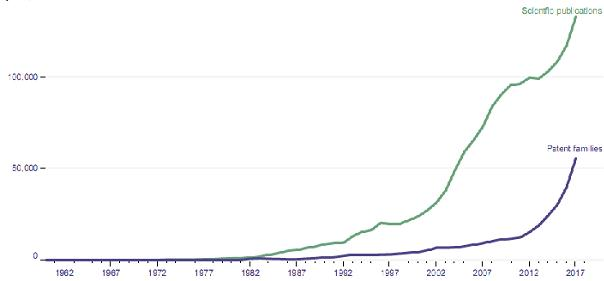

Trong lịch sử phát triển từ năm 1960 đến năm 2018, thế giới đã có gần 340.000 sáng chế đồng dạng và hơn 1,6 triệu bài báo khoa học liên quan đến phát triển trí tuệ nhân tạo được công bố. Trong thập niên 80, AI đã bắt đầu được quan tâm, nhưng đến những năm 2012 sự tăng tốc mới trở nên mạnh mẽ. Tuy trong giai đoạn 2006-2012, số công bố sáng chế bình quân tăng 8% trong một năm, nhưng đến giai đoạn 2012-2017 mức tăng đã đạt 28% trong một năm với số lượng đơn sáng chế liên quan đến AI tăng từ 8.515 trong năm 2006 lên đến 12.473 năm 2011 và 55.660 năm 2017 (tăng gấp 6, 5 lần trong vòng 12 năm).

Trong nghiên cứu khoa học, các công bố bài báo liên quan đến AI cũng tăng lên rất nhanh chóng, đặc biệt trong thời gian đến năm 2018 gần đây với 1.636.649 bài báo được công bố. Sự xuất hiện của các bài báo khoa học về AI bắt đầu sớm hơn 10 năm trước khi diễn ra cuộc chạy đua bảo hộ sáng chế công nghệ AI, điều đó đã chứng tỏ rằng kết quả của nghiên cứu khoa học cơ bản về AI đã có hiệu quả về mặt ứng dụng. Đặc biệt là khi các cuộc đua đăng ký bảo hộ sáng chế về trí tuệ nhân tạo AI gia tăng sau đó.

Số lượng sáng chế và số lượng bài báo theo năm công b

Nguồn: Xu hướng công nghệ 2019, WIPO

Không thể từ chối rằng sự phát triển của trí tuệ nhân tạo đã góp phần rất lớn trong công việc đẩy mạnh các ngành như như IoT (Internet of Things), blockchain, và Big Data đồng thời mở ra nhiều cơ hội mới trong việc ứng dụng và phát triển các các ngành tương tự. Tuy nhiên không thể phủ nhân rằng ứng dụng trí tuệ nhân tạo hiện tại đã và đang gây ra các vấn đề lớn. Là một trong những nguyên nhân dẫn đến nhiều tranh chấp trên các nước hiện nay được tính tại ngày 25/3/2024.

Ví dụ điển hình có thể thấy là về vụ kiện của trang báo chí nổi tiếng New York Times và Microsoft, OpenAI vì cáo buộc vi phạm bản quyền, tuyên bố rằng các công cụ AI chuyển hướng lưu lượng truy cập Internet “sẽ đi đến các tài sản web của trang báo New York Times ăn cắp thông tin, tước đi doanh thu quảng cáo, " vào ngày 27 tháng 12 năm 2023

Hoặc có thể mở rộng hơn, các thiệt hại mà các công ty phải đối mặt khi bên thứ ba sử dụng trí tuệ nhân tạo như Wacom, một trong những công ty hàng đầu sản xuất máy tính bảng và bút kỹ thuật số dành cho các nghệ sĩ, đã bị dính vào một tranh cãi khi phát hành một quảng cáo với hình ảnh một con rồng Trung Quốc được tạo ra từ ứng dụng trí tuệ nhân tạo. Khi vụ việc được phát hiện, Wacom đã nhanh chóng gỡ bỏ hình ảnh và đưa ra phản hồi mấy ngày sau đó cho biết những “hình ảnh vi phạm” được đến từ nhà cung cấp bên thứ ba và công ty không hề biết về việc trí tuệ nhân tạo đã được sử dụng để tạo ra chúng. Vụ việc đã gây ra nhiều lo ngại về mối quan hệ giữa các tập đoàn, các tác phẩm nghệ thuật được tạo ra bằng AI và sự phát triển của cộng đồng nghệ thuật trong tương lai.

Gần hơn là những vấn đề về lừa đảo khi những kẻ lừa đảo đã nhanh chóng tận dụng các tiến bộ trong việc sao chép giọng nói. Trong đó kẻ lừa đảo đã sử dụng công nghệ trí tuệ nhân tạo để tăng cường sự tinh vi của các kế hoạch gian lận của họ. Đã có nhiều báo cáo về những trường hợp mà kẻ lừa đảo đã sử dụng việc sao chép giọng nói của trí tuệ nhân tạo để đánh lừa nạn nhân với các kịch bản gian lận về tình huống khẩn cấp gia đình, tạo ra các tình huống thuyết phục các thành viên trong gia đình để phục vụ cho mục đích lừa đảo.

Mặc dù đi kèm với nhiều vấn đề, công nghệ trí tuệ nhân tạo AI có thể là chìa khóa để tiến tới việc giải quyết nhiều vấn đề cần thiết như việc cải tiến, cải cách bộ phận xử lý hành chính một cách hiệu quả và triệt để, giúp thay đổi đáng kế và giải quyết nhiều vấn đề, bất cập hiện nay về quản lý và điều hành của các cơ quan quản lý nhà nước các cấp. Điển hình là việc ứng dụng AI vào hệ thống chatbot (trả lời tự động) và trợ lý ảo tại các trung tâm hành chính của nước Singapore. Hệ thống cho phép người dân tự truy vấn thông tin từ hệ thống để nhận được câu trả lời cho vấn đề của mình một cách nhanh chóng, hiệu quả thay vì những tình trạng xếp hàng, chờ đợi như trước kia. Nhờ vào lượng dữ liệu khổng lồ lưu trữ trong cơ sở dữ liệu của chính phủ, AI có khả năng tổ chức và kết hợp nhiều bộ dữ liệu khác nhau để rút ra thông tin, cũng như tóm tắt một loạt các dạng dữ liệu để đưa ra phương án tốt nhất. Tuy nhiên để triển khai một cách hiệu quả nhất, vấn đề an ninh mạng và bảo mật thông tin cũng cần được quan tâm hơn bao giờ hết.

Do vây để đảm bảo rằng ứng dụng trí tuệ nhân tạo được thúc đẩy một cách bền vững và phù hợp với đạo đức của xã hội. Chúng ta cần có các biện pháp quản lý một cách cụ thể qua mô hình pháp lý. Điều này bao gồm việc xây dựng các quy định và chuẩn mực về việc sử dụng dữ liệu, bảo vệ quyền riêng tư, và đảm bảo rằng các hệ thống AI không gây ra các tác động tiêu cực không mong muốn cho xã hội.

Tóm lại, mặc dù trí tuệ nhân tạo mang lại nhiều cơ hội và tiềm năng cho xã hội, nhưng cũng đặt ra nhiều thách thức và rủi ro. Việc xây dựng và áp dụng môt hành lang pháp lý AI một cách có trách nhiệm và đạo đức là cần thiết để đảm bảo rằng công nghệ này mang lại lợi ích tối đa cho con người và xã hội.

Không thể phủ nhận vai trò ngày càng quan trọng của trí tuệ nhân tạo và các ứng dụng áp dụng trí tuệ nhân tạo trong tương lai nhưng nhìn chung việc xây dựng hành lang pháp lý cho Trí tuệ Nhân tạo (AI) là cực kỳ quan trọng để đảm bảo rằng việc triển khai và sử dụng AI được thực hiện một cách đúng đắn, an toàn và công bằng.

- Bảo vệ quyền con người: Việc phát triển AI có thể ảnh hưởng đến quyền lợi, quyền tự do và quyền riêng tư của con người do hệ thống cần số lượng dữ liệu cực kì nhiều để phát triển.

- Đảm bảo an toàn và độ tin cậy: AI thường hoạt động theo mệnh lệnh và có thể gây ra các hậu quả không mong muốn nếu hiểu sai về mệnh lệnh . Vì vậy cần có hành lang pháp lý để đặt ra các tiêu chuẩn và quy định đảm bảo rằng các hệ thống AI được thiết kế và triển khai một cách an toàn, tin cậy.

- Khuyến khích sáng tạo và đổi mới: Hành lang pháp lý tạo điều kiện thuận lợi để khuyến khích sự sáng tạo và đổi mới trong lĩnh vực AI. Điều này bao gồm việc bảo vệ và tôn trọng phát luật hiện tại nhưng vẫn tạo điều kiện cho việc chia sẻ kiến thức và dữ liệu liên quan đến ngành trí tuệ nhân tạo AI.

- Quản lý rủi ro: AI có thể gây ra các rủi ro về an ninh thông tin, đạo đức và xã hội vì vậy cần hành lang pháp lý để đảm bảo rằng các tổ chức và cá nhân sử dụng AI tuân thủ các quy định về pháp luật liên quan đến an ninh, đạo đức và xã hội.

Tóm lại, việc xây dựng hành lang pháp lý cho AI là cực kỳ quan trọng để đảm bảo sự phát triển và sử dụng của công nghệ này được thực hiện một cách an toàn, công bằng và có trách nhiệm.

Nếu chúng ta muốn kết hợp trí tuệ nhân tạo vào xã hội, chúng ta cần hiểu rõ nó là gì. thuật ngữ đó được hiểu như thế nào ? Công nghệ này đã phát triển ra sao? Chúng ta đang ở đâu trong quá trình này?

Tuy nhiên việc định nghĩa trí tuệ nhân tạo thật ra không hề dễ dàng. Thực tế, không có định nghĩa nào được chấp nhận chung về khái niệm này. Có quá nhiều định nghĩa khác nhau được sử dụng với nhiều hàm ý khác nhau, điều này có thể dễ dàng dẫn đến sự nhầm lẫn. Do đó, việc làm rõ thuật ngữ sử dụng là rất quan trọng. Do đó, tác giả sẽ bắt đầu bằng việc thảo luận các định nghĩa khác nhau liên quân về trí tuệ nhân tạo, từ đó tác giả sẽ giải thích rõ ràng quyết định của tác giả khi chọn dạng định nghĩa phù hợp cho bài báo cáo này. Tuy nhiên trước khi bắt đầu tác giả muốn nhấn mạnh rằng sự đa dạng về định nghĩa đang lưu thông hiện nay khi nhắc đến công nghệ trí tuệ nhân tạo không phải do sự thiếu sót của các nhà định nghĩa mà đó lại là đặc điểm tự nhiên của chính công nghệ trí tuệ nhân tạo.

Trong định nghĩa rộng nhất của nó, trí tuệ nhân tạo được coi là tương đương với các thuật toán (Algorithms). Tuy nhiên, đây không phải là một cách tiếp cận đặc biệt hữu ích cho phân tích của tác giả. Thuật toán đã tồn tại trước khi có trí tuệ nhân tạo và đã được sử dụng rộng rãi ngoài lĩnh vực này. Trong đó thuật toán 'algorithm' là sự thiết lập các tiêu chí hoặc hướng dẫn để giải quyết vấn đề hoặc hoàn thành một nhiệm vụ.. Nếu chúng ta định nghĩa trí tuệ nhân tạo chỉ đơn giản là việc sử dụng thuật toán, nó sẽ bao gồm nhiều hoạt động khác như các hoạt động của một máy tính cầm tay hoặc thậm chí là các hướng dẫn sử dụng của thuốc được gói kèm theo bọc thuốc.

Trong định nghĩa chặt chẽ nhất của nó, trí tuệ nhân tạo được nhiều người đề cập đến như một máy tính mô phỏng trí thông minh đã có sẵn trong con người. Tuy nhiên vẫn có nhiều ứng dụng đơn giản hiện nay không phải là trí tuệ nhân tạo thực sự. Ví dụ như là máy đo nhiệt độ hoặc máy tính cầm tay.

Một định nghĩa khác phổ biến của trí tuệ nhân tạo là “công nghệ cho phép máy móc mô phỏng các kỹ năng phức tạp của con người”. Tuy nhiên, điều này vẫn không cung cấp nhiều thông tin hơn bởi vì trong thực tế, sự thay đổi về góc nhìn con người về thuật ngữ ' các kỹ năng phức tạp của con người ' luôn thay đổi, có nhiều trường hợp mà kĩ năng phức tạp của con người vẫn có nhiều máy móc làm mà không cần đến sự tác động của con người. Ví dụ như game đánh cờ, đo đạc kích cỡ và nhiều thứ khác. Nếu những 'kỹ năng phức tạp của con người' không được chỉ định cụ thể, thì vẫn không rõ chính xác trí tuệ nhân tạo là gì. Điều tương tự cũng áp dụng cho định nghĩa trí tuệ nhân tạo là việc máy tính thực hiện các nhiệm vụ phức tạp trong môi trường phức tạp.

Ngoài ra chúng ta cũng có nhiều định nghĩa khác đi xa hơn trong việc giải thích những kỹ năng và nhiệm vụ này. Ví dụ như định nghĩa của nhóm chuyên gia cấp cao về trí tuệ nhân tạo (AI HLEG) của Ủy ban Châu Âu (EC): “Các hệ thống thể hiện hành vi thông minh bằng cách phân tích môi trường và thực hiện các hành động – với một mức độ tự chủ nhất định – để đạt được các mục tiêu cụ thể”. Số khác lại nói về khả năng nhận thức, đạt được mục tiêu, hành động từ việc học trong một vòng phản hồi.

Tuy các định nghĩa dựa trên nhiệm vụ đã có thể giúp chúng ta tiến xa hơn trong việc hỗ trợ chúng ta hiểu rõ hơn về trí tuệ nhân tạo. Tuy vậy chúng vẫn mang trong mình nhiều hạn chế. Các khái niệm như "một mức độ tự động hóa nhất định" vẫn còn quá mơ hồ. Hơn nữa, những định nghĩa này dường như quá rộng rãi khi mô tả những hiện tượng mà hầu hết chúng ta có lẽ sẽ không muốn gộp lại dưới thuật ngữ trí tuệ nhân tạo. Điển hình như đèn tự động hay máy cách nhiệt.

Tuy vậy dựa trên tất cả các định nghĩa khác nhau đã được thảo luận ở đây, tác giả đã quyết định chọn một định nghĩa mở cho bài nghiên cứu của trí tuệ nhân tạo này là “Các hệ thống thể hiện hành vi thông minh bằng cách phân tích môi trường của nó và thực hiện các hành động – với một mức độ tự quản lý để đạt được mục tiêu cụ thể.”. Có hai yếu tố quan trọng trong việc lựa chọn định nghĩa này của tác giả.

Thứ nhất, sẽ không khôn ngoan nếu mục đích của nghiên cứu này làm hạn chế định nghĩa của trí tuệ nhân tạo chỉ vào một phần cụ thể của công nghệ rộng lớn này. Bởi 1 định nghĩa quá hẹp sẽ đặt một số vấn đề ngoài phạm vi của nghiên cứu này.

Thứ hai, như đã thảo luận ở trên, bản chất của lĩnh vực khoa học này luôn phát triển và sẽ thay đổi theo thời gian. Một định nghĩa cố định của trí tuệ nhân tạo như là việc mô phỏng hoàn toàn trí thông minh của con người không có ích lợi gì cho mục đích của nghiên cứu về pháp luật này. Chúng ta cần một định nghĩa được các nước công nhận và bao gồm toàn bộ loạt ứng dụng đang được áp dụng trong thực tế cả ngày nay và trong tương lai gần . Vì vậy thay vì xem xét trí tuệ nhân tạo như một lĩnh vực khoa học có thể được phân chia rõ ràng với các định nghĩa đơn giản và phương pháp cố định, thì tác giả muốn người đọc xem nó như một lĩnh vực phức tạp đa dạng và luôn luôn phát triển theo thời gian theo xã hội con người.

1.2.2. Khái niệm của các công cụ ứng dụng của trí tuệ nhân tạo

Đáng lưu ý rằng các ứng dụng hiện tại được coi là trí tuệ nhân tạo theo định nghĩa hiện nay trên thị trường đều thuộc danh mục "hẹp" hoặc "yếu". Trí tuệ nhân tạo mà chúng ta quen thuộc ngày nay chỉ tập trung vào các kỹ năng cụ thể, như nhận dạng hình ảnh hoặc giọng nói, và ít liên quan đến toàn bộ các khả năng nhận thức con người .Vì vậy tác giả muốn nhấn mạnh về việc bài nghiên cứu này chỉ nghiên cứu về các ứng dụng trí tuê AI “hiện nay” và việc dùng các công cụ sử dụng trí tuệ nhân tạo thực hiện việc mô phỏng trí thông minh của con người vào máy móc để làm những việc mà chúng ta thường dựa vào con người.

Hiện nay có hai phương pháp đáng chú ý được nhiều nước ưa chuộng để điều chỉnh công nghệ trí tuệ nhân tạo AI:

- Có một bộ quy tắc áp dụng chung cho AI; (EU)

- Có nhiều bộ quy tắc, một bộ quy tắc cho mỗi lĩnh vực chịu ảnh hưởng của AI.

Tuy trong bối cảnh hiện tại nhiều nước chưa có bộ luật riêng chính thức nào để quản lý AI như luật trí tuệ nhân tạo của EU, dù vậy các quốc gia ít nhiều cũng đã có hệ thống để điều chỉnh một số loại hoạt động nhất định, bao gồm nhưng không giới hạn ở các tình huống mà hoạt động đó có thể được thực hiện bằng AI.

Lấy ví dụ như luật của Singapore nêu rằng bắt buộc cần phải có sự phê duyệt chính thức từ chính phủ để bất kỳ phương tiện nào, bao gồm (nhưng không giới hạn) phương tiện điều khiển bằng AI, lưu thông trên đường ở Singapore trong quy tắc Giao thông Đường bộ (Phương tiện cơ giới tự hành) 2017. Hoặc luật POFMA (Protection from Online Falsehoods and Manipulation Act) được áp dụng cho các tuyên bố sai sự thật gây tổn hại đến lợi ích công cộng, bao gồm (nhưng không giới hạn) các tuyên bố do trí tuệ nhân tạo AI tạo ra. Ngoài ra còn có phần "Thao tác trực tuyến" của POFMA, chứa các điều khoản liên quan đến bảo mật thông tin hay Đạo luật Bảo vệ khỏi Quấy rối quy định rằng các tuyên bố quấy rối và/hoặc gây tổn hại cho các cá nhân, bao gồm (nhưng không giới hạn) các tuyên bố do AI tạo ra. Ngoài ra luật pháp Singapore quy định rằng việc lừa dối ai đó là tội ác, cho dù bằng một bức thư viết tay giả mạo, một tin nhắn do AI tạo ra hay bất kỳ loại công nghệ nào khác.

Mặc dù vậy tác giả tin rằng hiện nay cách giải quyết vấn đề chỉ bằng những điều chỉnh của các điều luật cũ chỉ là biện pháp tạm thời. Bởi vì việc xây dựng một luật dành riêng cho AI có thể góp phần tốt hơn trong việc bảo vệ người dân và doanh nghiệp khỏi các rủi ro mà các quy định hiện có không tính đến. Ngoài ra nhà nước cần đảm bảo được sự hiệu quả và phù hợp của bộ luật với các lĩnh vực khi áp dụng AI cho người dân và doanh nghiệp. Do vậy việc xây dựng và phát triển một bộ luật riêng cho nền công nghệ này vẫn chiếm sự ưu tiên hàng đầu. Bằng chứng là hiện nay đã có rất nhiều nước đã tiến hành tiếp cận với nhiều phương thức khác nhau, công bố những thông báo kế hoạch xây dựng những điều luật dành riêng cho AI thay vì việc giữ lại các điều luật hiện hành và chỉ điều chỉnh thêm về "quy định trí tuệ nhân tạo" mà không có thêm thông tin cụ thể.

Việc tác giả lựa chọn nước nghiên cứu về trí tuệ nhân tạo AI là Trung Quốc, liên minh EU và Singapore là bởi vì cả 3 nước rất khác biệt trong hệ thống quản lý của chính phủ cũng như các chiến lược và ưu tiên của từng nước trong công cuộc phát triển đất nước và công nghệ của họ.

Trung Quốc: Với quyết tâm trở thành một cường quốc công nghệ và đầu tư lớn vào AI, Trung Quốc thường có những chiến lược và quy định chính sách mạnh mẽ để thúc đẩy sự phát triển trong lĩnh vực này. Tuy nhiên chính quyền Trung Quốc vẫn cần phải đảm bảo sự phù hợp với môi trường và mục tiêu chủ nghĩa xã hội của chính quyền Trung Quốc. Do vậy các chính sách của Trung Quốc sẽ đưa đến cho ta một góc nhìn khá bổ ích.

Liên minh EU: Với sự đa dạng về quốc gia và văn hóa, các nhà làm luật thường tập trung vào việc phối hợp, thỏa thuận và đồng tình giữa các nước thành viên trong liên minh EU để đạt được sự thống nhất trong quy định quản lý và phát triển công nghệ trí tuệ nhân tạo AI.

Singapore: với một chính phủ hiệu quả và quyết tâm đầu tư vào nghiên cứu và phát triển, các nhà làm luật thường tạo ra một môi trường thuận lợi cho các công ty và công việc nghiên cứu trong lĩnh vực trí tuệ nhân tạo.

Sự khác biệt trong hệ thống quản lý và chiến lược chính sách giữa các quốc gia này có thể là những cơ hội và thách thức riêng trong việc nghiên cứu về một hành lang pháp lý hiệu quả cho chính đất nước Việt Nam để vừa đảm bảo an toàn vừa khuyến khích cho sự phát triển của công nghệ mới là trí tuệ nhân tạo AI phù hợp với chuẩn mực xã hội và các kế hoạch quốc gia trong tương lai.

- Các yếu tố và vấn đề cần thiết cho pháp luật về AI giữa nhà nước và doanh nghiệp

- Các vấn đề pháp lý cần thiết để tạo nên một hành lang pháp lý hợp lý cho AI.

- Năng lực hiện có: năng lực của các tổ chức nhà nước hiện có, chẳng hạn như tòa án dân sự quốc gia. Trong đó việc các tổ chúc nhà nước đưa ra quyết định hợp lý để khắc phục những sai lầm hoặc tác hại do hệ thống AI gây ra là quan trọng nhất

- Nhiệm vụ và chức năng: Đánh giá những nhiệm vụ và chức năng để ra quyết định rằng việc nào không nên được giao cho hệ thống AI, các cơ chế nào có sự tham gia đảm bảo với sự phù hợp của các giá trị xã hội.

- Phát triển của pháp luật: Đánh giá liệu các quy định hiện hành có thể theo kịp sự phát triển của công nghệ trí tuệ nhân tạo hay không.

- Kiểm soát: Nhà nước ta có đủ nguồn lực để kiểm soát các hoạt động của các dịch vụ và công ty cung cấp trí tuệ nhân tạo hay không

- Các yếu tố cần thiết để có thể khuyến khích việc ứng dụng hợp lý cho doanh nghiệp

- Khả năng tương thích kỹ thuật : Khả năng tương thích kỹ thuật là yếu tố quan trọng quyết định liệu một đổi mới có được áp dụng hay không. Trong trường hợp này đó là công nghệ trí tuệ nhân tạo. Nó đề cập đến mức độ tương thích của một sự đổi mới và khả năng mang lại giá trị và trải nghiệm đồng thời đáp ứng yêu cầu của người dùng tiềm năng khi ứng dụng trí tuệ nhân tạo. Nếu khả năng tương thích ở mức cao có thể dẫn đến việc áp dụng tốt hơn. Do các ứng dụng trí tuệ nhân tạo, đặc biệt là học máy, đòi hỏi lượng dữ liệu khổng lồ. Nếu công nghệ AI tương thích và phù hợp với môi trường CNTT và cơ sở hạ tầng hiện có thì việc cài đặt cho trí tuệ nhân tạo vào hệ thống có thể sẽ ít tốn kém và thời gian hơn.

- Lợi thế tương đối: lợi thế tương đối của một đổi mới là mức độ mà nó được coi là ưu việt hơn so với chiến lược mà nó sẽ thay thế. Xu hướng áp dụng công nghệ mới của một tổ chức thường bị ảnh hưởng bởi nhận thức về sự đổi mới. Vì vậy các công nghệ mới mang lại lợi ích rõ ràng về mặt hiệu quả chiến lược và hoạt động sẽ có nhiều khả năng được chấp nhận hơn. Gần đây, có thể thấy AI đã được nhiều doanh nghiệp hoặc nhà nước sử dụng trong các chatbot dịch vụ khách hàng, dịch vụ thoại và lời nói trực tiếp với khách hàng cũng như vận hành mạng tự động. Những ứng dụng này sẽ giúp cắt giảm chi phí hoạt động, nâng cao hiệu quả chất lượng dịch vụ, trải nghiệm tới khách hàng và tăng hiệu quả.

- Độ phức tạp về mặt kỹ thuật: độ phức tạp về mặt kỹ thuật của một đổi mới thể hiện mức độ mà nó được coi là khó hiểu và khó sử dụng. Sự phức tạp của AI bắt nguồn từ việc thiếu sự trưởng thành, thiếu năng lực công nghệ và chuyên gia CNTT, cũng như thời gian phát triển kéo dài và chi phí cao trong tình hình hiện nay. Đó cũng đồng thời giải thích tại sao các doanh nghiệp hay có thói quen trì hoãn việc áp dụng nội bộ một công nghệ phức tạp cho đến khi họ tích lũy đủ kiến thức kỹ thuật để triển khai và vận hành nó thành công. Điều này vô hình chung cản lại sự phát triển của đất nước, đặc biệt là khi chúng ta muốn phát triện công nghệ này tại Việt Nam. Tuy vậy điều này lại không đáng trách dẫu vì hiện nay, AI vẫn còn khá mới mẻ đối với nhiều doanh nghiệp với điều kiện khắc khe là nuốn vốn hiểu biết sâu sắc về ứng dụng AI và nhân lực tiềm năng cho công nghệ trí tuệ nhân tạo AI

- Năng lực quản lý: thuật ngữ “năng lực quản lý” đề cập đến khả năng của người quản lý trong việc gây ảnh hưởng, động viên và trao quyền cho nhân viên để đóng góp vào hiệu suất và thành công của tổ chức. Trong đó, năng lực quản lý bao gồm việc điều phối dự án, giáo dục & đào tạo. Các doanh nghiệp có năng lực quản lý tốt có thể khắc phục những trở ngại này và nhanh chóng áp dụng các công nghệ mới. Từ đó, doanh nghiệp nhanh chóng triển khai các công nghệ AI và tăng hiệu suất, đạt được lợi thế cạnh tranh.

- Sự tham gia của chính phủ: sự tham gia của chính phủ rất quan trọng trong việc thúc đẩy đổi mới. Chính phủ có thể thực hiện các chiến lược và chính sách hỗ trợ để khuyến khích thương mại hóa công nghệ mới cũng như các quy định mới cho sự phát triển của công nghệ trí tuệ nhân tạo AI.

- Sự không chắc chắn của thị trường: các yếu tố không chắc chắn của thị trường, chẳng hạn như nhu cầu sản phẩm, cạnh tranh thị trường và lòng trung thành của người tiêu dùng, nằm ngoài tầm kiểm soát của doanh nghiệp nhưng có thể có tác động đến hiệu quả đến quyết định hoạt động khi ứng dụng công nghệ trí tuệ nhân tạo AI. Tuy nhiên điều này đã không ngăn cản nhiều ứng dụng và phần mềm ứng dụng AI phát triển. Tuy hiện nay việc phát triển công nghệ trí tuệ nhân tạo AI vẫn còn đang ở giai đoạn sơ khai, còn gặp rất nhiều vấn đề do thiếu nguồn lực, chuyên gia kỹ thuật và chuyên môn phù hợp. Tuy vậy AI đã chứng tỏ được sức sống đáng kể với triển vọng mang đến cho doanh nghiệp những lợi thế cạnh tranh.

- Quan hệ đối tác với nhà cung cấp: Sự tham gia của nhà cung cấp có thể ảnh hưởng đáng kể đến tỷ lệ áp dụng và phổ biến các sản phẩm đổi mới liên quan đến AI. Để đào tạo công nghệ AI cần một lượng lớn dữ liệu, thường bao gồm thông tin nhạy cảm của người tiêu dùng. Do vậy việc phát triển quan hệ đối tác giữa các nhà cung cấp thông tin là cần thiết

- Các vấn đề vi phạm pháp luật đã và đang xảy ra do công nghệ trí tuệ nhân tạo.

Tình trạng sử dụng kép công nghệ khi thực hiện hành động phạm pháp luật không phải là một vấn đề hoàn toàn mới khi nói đến tội phạm. Với khả năng của trí tuệ nhân tạo (AI) với năng lực ngày càng phát triển nhanh chóng và ảnh hưởng đến hầu hết mọi lĩnh vực của xã hội. AI có thể bị lợi dụng để sử dụng với mục đích xấu, lạm dụng để tạo ra những lỗ hổng hoặc những chiêu trò tinh vi mới. Do vậy việc đánh giá bối cảnh đe dọa một cách thường xuyên cho công nghệ trí tuệ nhân tạo AI này là rất quan trọng trong việc sáng tạo và điều chỉnh các cơ chế quản trị pháp luật đối với ngành công nghệ mới này.

1.4.1 Lạm dụng AI một cách ác ý: Lỗ hổng của các mô hình AI

A. Tấn công trực tiếp vào mô hình AI

Việc phát triển trí tuệ nhân tạo AI cần những thông tin chính xác và hữu ích để có thể hoạt động tốt nhất. Điều này vô hình chung đã tạo ra những kẻ hở cho những kẻ có í định xấu bằng việc thao túng dữ liệu cơ bản, khiến các mô hình công nghệ AI dễ bị tấn công. Đã có nhiều trường hợp tin tặc cố gắng đưa thông tin sai lệch vào hệ thống để làm hỏng dữ liệu, làm giảm độ tin cậy của thông tin khiến hệ thống AI mắc sai lầm trong các công việc được giao.

B. Kết quả ngoài ý muốn của việc sử dụng AI

Trí tuệ nhân tạo có thể mang lại kết quả không như mong đợi của nhà cung cấp và nhà phát triển AI. Ví dụ, các mô hình có thể vô tình sử dụng dữ liệu riêng tư hoặc nhạy cảm để huấn luyện. Điều này có thể dẫn đến các vấn đề lộ thông tin không mong muốn. Lý do là vì những mô hình như vậy có khả năng ghi nhớ những chi tiết không liên quan đến nhiệm vụ chính của chúng, dẫn đến việc vô tình tiết lộ thông tin của cá nhân thông qua các thuật toán. Điều này có thể gây ra những hậu quả có hại, bao gồm việc ăn cắp thông tin cá nhân để thực hiện mục đích xấu, vi phạm quyền riêng tư của người dùng.

1.4.2 Sử dụng AI có mục đích xấu: Các cuộc tấn công được kích hoạt bởi AI và được tăng cường bởi AI

A. Lừa dối và lừa đảo

Các tin tặc có thể tận dụng công nghệ trí tuệ nhân tạo để phát triển những "bot xã hội" tinh vi, nhằm mục đích lừa dối và chi phối những người dùng tuân theo yêu cầu của chúng. Những "bot xã hội" này là những chương trình máy tính được lập trình để mô phỏng hành vi con người, sử dụng ngôn ngữ tự nhiên để gây sự chú ý của người dùng và thuyết phục họ chia sẻ thông tin cá nhân hoặc nhấp vào các liên kết lừa đảo.

B. Thao túng

Ngoài hành động nhắm đến việc pham phát được mô tả trong phần trước, ngoài ra còn một số lượng lớn bot khác được tạo ra để hỗ trợ các hành động có mục đích ảnh hưởng đến dư luận bằng cách đăng lại nội dung cụ thể một cách nhiều lần để tạo ấn tượng hòng đánh lừa người dùng trên nền tảng truyền thông xã hội

C. Thông tin sai lệch và tin giả

Sự phát triển và phổ biến của công nghệ, nền tảng blog và phương tiện truyền thông xã hội đã thay đổi cách các cá nhân tiêu thụ thông tin, truy cập các mục tin tức và hình thành ý kiến. Tốc độ nhanh của Internet cũng cho phép mọi người tạo và chia sẻ nhanh chóng khiến cho các nội dung sai lệch được tạo ra từ công nghệ trí tuệ nhân tạo AI có thể tiếp cận nhiều người hơn. Có ảnh hưởng xấu đến người tiêu thụ thông tin

Ví dụ bằng các công cụ như GPT-3 có thể thúc đẩy việc tạo ra các văn bản nhằm mục đích đưa thông tin sai lệch. (GPT-3 là mô hình ngôn ngữ tự hồi quy sử dụng deep learning để hoàn thành các nhiệm vụ như trả lời câu hỏi, hoàn thành văn bản và tóm tắt.) Do định dạng, lựa chọn từ ngữ và tính nhất quán, văn bản được tạo tự động bằng công cụ này có thể trông giống như được viết bởi con người, gây nhầm lẫn cho người đọc do độ tin cậy khá rõ ràng.

D. Giả mạo: Deepfake

Nổi bật về hành vi giả mạo trong thời đại kỹ thuật số là các video và hình ảnh giả mạo. Các phương tiện truyền thông có thể áp dụng AI trong quá trình sáng tạo để tạo ra một video bao gồm người đang nói hoặc làm những điều không hề xảy ra. Việc sử dụng AI để làm giả video và hình ảnh tạo ra chất liệu chân thực, gây khó khăn cho việc phân biệt thật giả. Mặc dù trường hợp thao túng bằng video như vậy không phải là mới, đặc biệt là sau khi các chương trình như Photoshop trở nên phổ biến, tuy nhiên công nghệ trí tuệ nhân tạo AI khiến việc giả mạo trở nên dễ dành hơn lúc trước rất nhiều.

VD: Vào cuối tháng 1 năm 2024, những hình ảnh deepfake khiêu dâm do AI tạo ra của nhạc sĩ người Mỹ Taylor Swift đã được lan truyền rộng rãi trên các nền tảng truyền thông xã hội 4chan và X. Một số hình ảnh nhân tạo của Swift có tính chất tình dục hoặc bạo lực đã nhanh chóng được lan truyền với một bài đăng được cho là đã được xem hơn 47 triệu lần trước khi bị xóa.

E. Nhiệm vụ lặp đi lặp lại

AI cũng hoạt động hiệu quả trong việc thực hiện các nhiệm vụ lặp đi lặp lại có thể được sử dụng với mục đích xấu. Ví dụ như spam, phá mật khẩu…

F. Hệ thống vũ khí tự động

Một trong những rủi ro của công nghệ mới nổi này là khả năng phần mềm được ứng dụng vào quân sự (ví dụ: máy bay không người lái) bị các tác nhân độc hại làm thay đổi. Nếu một máy bay không người lái bị tin tặc tấn công khiến vị trí GPS của cuộc tấn công thay đổi, nó sẽ hoạt động theo các quy tắc mới được đặt trong phần mềm. Điều này có thể dẫn đến thương vong ngoài ý muốn do mục tiêu bị chuyển hướng. Tương tự, nếu dữ liệu dùng để huấn luyện hệ thống trí tuệ nhân tạo bị lỗi, điều này có thể dẫn đến nhiều hậu quả tai hại.

Chương 2: Pháp luật quản lý AI ở nước ngoài – Thực trạng và tình hình quản lý

2.1. Sơ lược về phương pháp tiếp cận và quản lý của liên minh EU đối với công nghệ trí tuệ nhân tạo AI

2.1.1. Tổng quan về Đạo luật AI của EU

Đạo luật AI của EU

Vào ngày 9 tháng 12 năm 2023, các nhà đàm phán của Nghị viện Châu Âu và chủ tịch Hội đồng đã đồng ý về phiên bản cuối cùng của khung pháp lý toàn diện đầu tiên trên thế giới về Trí tuệ nhân tạo; Đạo luật trí tuệ nhân tạo của Liên minh châu Âu ("Đạo luật AI của EU").

Đạo luật cấm triển khai các hệ thống AI gây ra “rủi ro không thể chấp nhận” ở Liên minh châu Âu và áp đặt các mức nghĩa vụ khác nhau đối với các hệ thống AI được phân loại là “rủi ro cao” hoặc “rủi ro hạn chế”. Một số thỏa thuận đã đạt được để điều chỉnh việc triển khai các mô hình nền tảng, bao gồm việc áp dụng các biện pháp đảm bảo tuân thủ luật bản quyền châu Âu. Ngoài ra đạo luật còn có các yêu cầu các tiêu chí như quy định việc xuất bản các bản tóm tắt chi tiết về nội dung được sử dụng để đào tạo các hệ thống trí tuệ nhân tạo và tài liệu kỹ thuật liên quan đến việc sử dụng các mô hình trí tuệ nhân tạo.

Lịch sử về Đạo Luật AI của EU

Vào tháng 10 năm 2020, các nhà lãnh đạo EU đã thảo luận về quá trình chuyển đổi kỹ thuật số. Trong phần kết luận, Hội đồng Châu Âu đã mời Ủy ban đề xuất các cách để tăng đầu tư công và tư của châu Âu và quốc gia vào nghiên cứu, đổi mới và triển khai trí tuệ nhân tạo đồng thời yêu cầu việc cung cấp một định nghĩa rõ ràng, khách quan về các hệ thống trí tuệ nhân tạo.

Vào ngày 6 tháng 12 năm 2022 sau thời gian dài nghiên cứu và thảo luận. Hội đồng đã chấp thuận quan điểm chung về đạo luật trí tuệ nhân tạo .Thông qua đó quan điểm ("cách tiếp cận chung") về đạo luật trí tuệ nhân tạo AI được chấp thuận. Các quy định mới được đề xuất với mục tiêu rõ ràng là đảm bảo rằng các hệ thống trí tuệ nhân tạo được áp dụng trong thị trường Liên minh châu Âu tuân thủ các nguyên tắc về an toàn và tôn trọng đạo đức, đồng thời bảo vệ các quyền cơ bản và giá trị của Liên minh.

Vào ngày 9 tháng 12 năm 2023. Sau các cuộc đàm phán kéo dài 3 ngày, Hội đồng và Nghị viện Châu Âu đã đạt được thỏa thuận về luật từ nhiều tháng đàm phán. Văn bản cuối cùng chính thức đã được thông qua bởi cả Hội đồng và Nghị viện, với tư cách là các nhà đồng lập pháp của EU. Đạo luật AI được thông báo là sẽ có hiệu lực áp dụng từ năm 2026 trở đi.

2.1.2 Các điểm chú ý trong đạo luật EU

Mục tiêu của đạo luật AI.

Đảm bảo rằng các hệ thống AI được đưa ra thị trường Liên minh và được sử dụng là an toàn và tôn trọng các luật hiện hành về quyền cơ bản và giá trị của Liên minh;

Đảm bảo sự chắc chắn về mặt pháp lý đồng thời tạo điều kiện thuận lợi cho đầu tư và đổi mới trong lĩnh vực trí tuệ nhân tạo AI;

Tăng cường công tác quản trị và thực thi hiệu quả luật hiện hành về các quyền cơ bản và yêu cầu an toàn áp dụng cho hệ thống AI;

Tạo điều kiện để phát triển một thị trường duy nhất hợp pháp, an toàn và đáng tin cậy cho các ứng dụng trí tuệ nhân tạo AI, đồng thời ngăn chặn sự phân mảnh thị trường.

2.1.3 Tiến trình quản lý trong đạo luật trí tuệ nhân tạo của EU

2.1.3.1. Khái niệm và cách phân loại các hệ thống trí tuệ nhân tạo của đạo luật EU

Với phạm vi rộng lớn và liên tục thay đổi của các giải pháp và ứng dụng trí tuệ nhân tạo AI, Đạo luật AI của EU định nghĩa trí tuệ nhân tạo AI một cách rộng rãi như sau: về cơ bản, bất kỳ hệ thống dựa trên dữ liệu nào được triển khai ở EU, bất kể được phát triển ở đâu hoặc lấy nguồn dữ liệu ở các nước thuộc liên minh EU sẽ thuộc phạm vi điều chỉnh luật AI. Với định nghĩa sâu rộng như vậy, EU áp dụng cách tiếp cận và phân loại các loại AI dựa trên rủi ro để điều chỉnh, áp đặt các yêu cầu khác nhau đối với các mức độ rủi ro khác nhau.

Trong đạo luật trí tuệ nhân tạo của EU, các hệ thống và ứng dụng của trí tuệ nhân tạo sẽ chia thành 3 phần dựa theo chỉ số rủi ro của hệ thống AI. Trong đó bao gồm:

- Hệ thống có rủi ro không thể chấp nhận

- Hệ thống có rủi ro cao

- Hệ thống có rủi ro rất thấp hoặc không có rủi ro

Hệ thống có rủi ro không thể chấp nhận được bao gồm tất cả các hệ thống AI được coi là trái với giá trị theo quy định của liên minh EU sẽ bị cấm bao gồm từ việc chấm điểm xã hội của chính phủ đến các hệ thống nhằm mục đích thao túng trẻ em hoặc các nhóm dễ bị tổn thương khác, việc sử dụng hệ thống nhận dạng sinh trắc học từ xa ‘thời gian thực’ trong các không gian có thể truy cập công cộng nhằm mục đích thực thi pháp luật cũng bị cấm trừ khi áp dụng một số trường hợp ngoại lệ hạn chế nhất định.

Hệ thống có rủi ro cao sẽ được xác lập thành 2 phần. Do hệ thống được quy định phải phù hợp với luật an toàn sản phẩm hiện hành. Vì vậy, việc phân loại hệ thống trí tuệ nhân tạo có rủi ro cao không chỉ phụ thuộc vào chức năng được thực hiện bởi hệ thống trí tuệ nhân tạo AI mà còn phụ thuộc vào mục đích và phương thức cụ thể mà hệ thống đó được sử dụng.

Với việc phân tích của theo mục đích và phương thức cụ thể của hệ thống trí tuệ nhân tạo AI. Hệ thống trí tuệ nhân tạo AI sẽ được coi là có rủi ro cao khi đáp ứng 1 trong 2 điều kiện sau đây

- Hệ thống trí tuệ nhân tạo AI được thiết kế để sử dụng như một thành phần an toàn của sản phẩm hoặc bản thân nó là một sản phẩm, được quy định trong luật hài hòa của Liên minh được liệt kê trong Phụ lục II;

- Sản phẩm có thành phần an toàn là hệ thống AI hoặc bản thân hệ thống AI dưới dạng sản phẩm phải trải qua đánh giá sự phù hợp của bên thứ ba nhằm đưa sản phẩm đó ra thị trường hoặc đưa vào sử dụng theo luật của Liên minh

Ngoài ra hệ thống trí tuệ nhân tạo AI sẽ được coi là hệ thống có rủi ro cao nếu nằm trong các ngành sau đây

- Nhận dạng sinh học và phân loại con người

- Quản lý và vận hành cơ sở hạ tầng quan trọng

- Giáo dục và đào tạo nghề

- Việc làm, quản lý người lao động và khả năng tự tạo việc làm

- Đưa ra quyết định tiếp cận và hưởng thụ các dịch vụ tư nhân thiết yếu cũng như các dịch vụ và lợi ích công cộng

- Thực thi pháp luật

- Quản lý di cư, tị nạn và kiểm soát biên giới

- Quản lý công lý và các tiến trình dân chủ

Hệ thống có rủi ro rất thấp thuộc về những hệ thống còn lại như chatbot, trò chơi điện tử có hỗ trợ AI hoặc bộ lọc thư rác.

2.1.3.2. Mô hình quản lý của đạo luật EU đối với các hệ thống trí tuệ nhân tạo

Về cơ bản bộ luật tập trung vào việc quản lý các hệ thống trí tuệ nhân tạo có rủi ro cao với các yêu cầu về thiết lập, triển khai, ghi chép và duy trì liên quan đến các hệ thống AI có rủi ro cao được quy định trong đạo luật trí tuệ nhân tạo AI. Trong đó hệ thống quản lý rủi ro bắt buộc phải bao gồm một quy trình lặp đi lặp lại liên tục trong toàn bộ vòng đời của hệ thống AI có rủi ro cao đồng thời cập nhật hệ thống thường xuyên. Việc quản lý hệ thống trí tuệ nhân tạo sẽ bao gồm các bước như sau:

(a) Xác định và phân tích các rủi ro đã biết và có thể lường trước được liên quan đến từng hệ thống AI có rủi ro cao;

(b) Ước tính và đánh giá các rủi ro có thể xuất hiện khi sử dụng hệ thống AI có rủi ro cao theo đúng mục đích đã định và trong các trường hợp sử dụng sai có thể dự đoán trước một cách hợp lý;

(c) đánh giá các rủi ro khác có thể phát sinh dựa trên việc phân tích dữ liệu thu thập được từ hệ thống giám sát sau thị trường

(d) áp dụng các biện pháp quản lý rủi ro phù hợp theo quy định

Tài liệu kỹ thuật của hệ thống AI có rủi ro cao phải được soạn thảo trước khi hệ thống đó được đưa ra thị trường hoặc đưa vào sử dụng và phải được liên tục cập nhật. Đồng thời, các hệ thống có rủi ro cao trước khi ra mắt thị trường sẽ được thử nghiệm nhằm mục đích xác định các biện pháp quản lý rủi ro phù hợp nhất. Việc thử nghiệm cũng là một quy trình để loại bỏ hoặc giảm thiểu rủi ro đến mức có thể thông qua thiết kế và phát triển phù hợp. Khi ban kiểm soát quy định được sự thích hợp đối với thị trường thì các nhà cung cấp bắt buộc phải đưa ra những quy định để giảm thiểu và kiểm soát thích hợp liên quan đối với những rủi ro không thể loại bỏ được

Tuy nhiên khi đã qua quy trình này các nhà cung cấp hệ thống trí tuệ nhân tạo AI vẫn phải chịu sự giám sát sau thị trường của chính phủ bao gồm việc thiết lập và ghi lại hệ thống giám sát sau khi ra mắt thị trường đồng thời báo cáo các sự cố nghiêm trọng và trục trặc liên quan đến hệ thống AI một cách nhanh chóng cho chính phủ. Ngoài ra mọi thay đổi đối với hệ thống AI và hiệu suất của nó phải được báo cáo trong tài liệu kỹ thuật theo quy định.

Ngoài ra các hệ thống AI có rủi ro cao phải được thiết kế và phát triển với khả năng cho phép ghi lại tự động các sự kiện (‘nhật ký’) khi hệ thống AI có rủi ro cao đang hoạt động. Những khả năng ghi nhật ký đó phải tuân theo các tiêu chuẩn được công nhận hoặc thông số kỹ thuật chung đồng thời các nhà cung cấp phải xây dựng cơ chế giám sát kết hợp ‘con người- công cụ giao diện máy' để đảm bảo hệ thống hoạt động hiệu quả.

2.1.4. Quản lý và thực thi của Đạo Luật AI EU

Thành lập Ban trí tuệ nhân tạo châu Âu

Các quy tắc đề xuất ở đạo luật AI EU sẽ được thực thi thông qua hệ thống quản trị ở cấp Quốc gia Thành viên, xây dựng trên các cơ cấu pháp luật hiện có với cơ chế hợp tác ở cấp Liên minh bằng việc thành lập Ban Trí tuệ Nhân tạo Châu Âu

Nhiệm vụ của ban trí tuệ châu Âu sẽ bao gồm:

- Góp phần vào sự hợp tác hiệu quả của các cơ quan giám sát quốc gia và Ủy ban về các vấn đề thuộc quy định trong đạo luật AI

- Điều phối và đóng góp vào hướng dẫn vào phân tích của Ủy ban, các cơ quan giám sát quốc gia và các cơ quan có thẩm quyền khác về các vấn đề trí tuệ nhân tạo trên thị trường nội bộ liên quan đến các vấn đề thuộc đạo luật AI;

- Hỗ trợ các cơ quan giám sát quốc gia và Ủy ban trong việc đảm bảo áp dụng nhất quán trong đạo luật AI.

Cơ cấu của ban

Ban Trí tuệ Nhân tạo Châu Âu mới được thành lập sẽ do Ủy ban Châu Âu chủ trì và sẽ có một đại diện từ mỗi cơ quan giám sát quốc gia và Ban Bảo vệ Dữ liệu Châu Âu

Hội đồng sẽ do ủy ban EU chủ trì. Ủy ban sẽ triệu tập các cuộc họp và chuẩn bị chương trình nghị sự phù hợp với nhiệm vụ của Hội đồng theo quy định thuộc đạo luật AI của EU và các quy tắc thủ tục của Hội đồng

Ở cấp quốc gia, các Quốc gia Thành viên sẽ phải chỉ định một hoặc nhiều cơ quan có thẩm quyền trong nước, trong đó có cơ quan giám sát quốc gia, nhằm mục đích giám sát việc áp dụng và thực hiện quy định trong đạo luật AI này. Trong đó, cơ quan Giám sát bảo vệ dữ liệu Châu Âu sẽ đóng vai trò là cơ quan có thẩm quyền giám sát các tổ chức, cơ quan và cơ quan của Liên minh khi chúng nằm trong phạm vi của quy định về đạo luật AI.

2.1.5 Phân tích lợi thế và bất lợi thế đến từ đạo luật này.

Lợi thế

Đạo luật AI của EU sẽ có lợi cho thị trường việc làm của kỹ sư máy học và Khoa học dữ liệu. Với nhiều quy định về các nghĩa vụ bao gồm các yêu cầu về tài liệu, biện pháp kiểm soát và kiểm tra chính xác áp dụng cho tất cả các mô hình trí tuệ nhân tạo AI. Việc này sẽ đảm bảo sự tương tác của con người bao gồm trực tiếp và gián tiếp. Từ đó thúc đẩy nhu cầu về các chuyên gia giúp xây dựng, duy trì và phát triển hệ thống AI để đảm bảo với việc tuân thủ luật hiện hành.

Đạo luật AI của EU tạo tiền lệ cho các biện pháp bảo vệ để đảm bảo AI được sử dụng một cách có đạo đức và trách nhiệm, thúc đẩy niềm tin của công chúng và cho phép AI đóng góp tích cực cho xã hội.

Đảm bảo tính minh bạch với yêu cầu tiết lộ và thông báo nội dung được tạo bằng trí tuệ nhân tạo cũng như thông báo cho người hiểu rõ họ đang phải đối mặt với một trí tuệ nhân tạo AI ( như Chat Box) (điều 52)

Thúc đẩy quan hệ đối tác công-tư thông qua việc quy định về việc kiểm tra và quản lý trong môi trường độc lập trước khi đưa sản phẩm AI ra thị trường,tạo điều kiện thuận lợi cho việc thu nhập bằng chứng toàn diện hơn phục vụ cho việc thực thi luật và thu nhập thông tin phục vụ cho việc xây dựng và triển khai pháp luật về trí tuệ nhân tạo AI một cách nhanh chóng hơn (điều 53)

Đạo luật AI EU loại bỏ các quy định về nghĩa vụ song song trong trong các thủ tục hiện có giảm tình trạng quan liêu về trí tuệ nhân tạo, khuyến khích cho sự phát triển của công nghệ trí tuệ nhân tạo AI

Đảm bảo việc đẩy nhanh việc chia sẻ thông tin về pháp luật và kĩ thuật cho bên cung cấp và bên triển khai trí tuệ nhân tạo AI. Giúp cho hai bên hiểu rõ hơn về rủi ro và cách dùng công nghệ trí tạo AI.(điều 28)

Bất lợi

Ngưỡng tài chính dự kiến cần thiết để phát triển sản phẩm hoặc dịch vụ trí tuệ nhân tạo sẽ được nâng lên nhiều hơn theo khối lượng công việc trong quy định. Điều này có nghĩa là sẽ có ít sản phẩm và dịch vụ liên quan đến AI mới được phát triển hơn. Việc này kìm hãm sự phát triển của các doanh nghiệp nhỏ do phải chịu chi phí lớn về thời gian lẫn tài chính, ảnh hưởng xấu đến sự phát triển của đất nước cả về kinh tế lẫn công nghệ

Đạo luật về Trí tuệ Nhân tạo (AI) đang tạo ra một hệ thống quản trị quá phức tạp bởi vì nó kết hợp nhiều cơ quan có thẩm quyền khác nhau, và còn phụ thuộc vào cơ quan của các cấp độ quốc gia. Điều này có thể dẫn đến nhiều cuộc tranh giành quyền lực không cần thiết, và tạo ra sự bất đồng trong việc hiểu và thực thi luật do mỗi cơ quan có cách tiếp cận và cách hiểu khác nhau trong lĩnh vực này.

Các nhà cung cấp hệ thống AI phải đối mặt với nhiều yêu cầu nghiêm ngặt trước và sau khi sản phẩm của họ ra thị trường để đảm bảo tính đáng tin cậy, minh bạch và trách nhiệm của hệ thống AI. Điều này có thể làm nản lòng và giảm sự quan tâm của nhà đầu tư và các nhà cung cấp tiềm năng đối với các sản phẩm và dịch vụ liên quan đến trí tuệ nhân tạo.

2.2 Sơ lược về phương pháp tiếp cận và quản lý của Trung Quốc đối với công nghệ trí tuệ nhân tạo AI

Trong khi các khu vực pháp lý khác (ví dụ: EU, Brazil và Canada) tập trung vào việc đảm bảo hệ thống AI không vi phạm các quyền của cá nhân, thì luật AI hiện hành của Trung Quốc lại tập trung đặc biệt vào việc đảm bảo rằng hệ thống AI không được sử dụng để “gây nguy hiểm cho an ninh quốc gia hoặc lợi ích công cộng xã hội”.

2.2.1 Tình hình của Trung Quốc đối với AI

Trung Quốc là một trong những nước đầu tiên thực hiện quy định về AI. Hiện nay nhà lập pháp Trung Quốc đang ở trong quá trình soạn thảo luật pháp để quy định AI một cách toàn diện. Tuy nhiên Trung Quốc cũng đã có nhiều quy định và chính sách khác nhau áp dụng cho từng trường hợp cụ thể đối với việc sử dụng và cung cấp các dịch vụ liên quan đến trí tuệ nhân tạo

- Quy định quản lý đề xuất thuật toán dịch vụ thông tin Internet

Trường hợp sử dụng AI đầu tiên mà Trung Quốc quyết định quản lý là các thuật toán đề xuất trên internet, đặc biệt là những thuật toán có "đặc điểm dư luận" và "khả năng huy động xã hội" thông qua "Quy định quản lý đề xuất thuật toán dịch vụ thông tin Internet" đã được xem xét và thông qua tại cuộc họp văn phòng lần thứ 20 của Cục quản lý không gian mạng Trung Quốc vào ngày 31 tháng 12 năm 2021 và đã có hiệu lực từ ngày 1 tháng 3 năm 2022.

Trong đó các quy định áp dụng cho bất kỳ tổ chức nào sử dụng công nghệ đề xuất thuật toán để cung cấp dịch vụ thông tin Internet ở Trung Quốc đại lục. (Algorithm). Điều này bao gồm việc sử dụng thuật toán “đề xuất” hoặc thuật toán quyết định nội dung tương tự trong các ứng dụng và trang web được sử dụng ở Trung Quốc

Trong đó có một số quy định chính bao gồm:

- Yêu cầu các công ty đăng ký thuật toán thuộc mô hình AI của họ vào cơ sở dữ liệu trực tuyến

- Yêu cầu các công ty hoàn thành báo cáo tự đánh giá an ninh của thuật toán sử dụng

- Yêu cầu các công ty phải minh bạch về cách đào tạo và triển khai các thuật toán đề xuất của họ (bao gồm cả tập dữ liệu mà thuật toán được đào tạo)

- Cung cấp cho người dùng quyền từ chối các thuật toán đề xuất

- Cấm việc sử dụng các thuật toán đề xuất cho mục đích bất hợp pháp hoặc có hại.

- Quy định về công nghệ tích hợp sâu của Trung Quốc

Vào ngày 3 tháng 11 năm 2022 "Quy định về quản lý tích hợp chuyên sâu các dịch vụ thông tin Internet" đã được xem xét và thông qua tại cuộc họp văn phòng lần thứ 21 của Cục Quản lý không gian mạng Trung Quốc có hiệu lực từ ngày 10 tháng 1 năm 2023. Trong đó quy định áp đặt nghĩa vụ đối với các nhà cung cấp và người sử dụng “công nghệ tích hợp sâu” (học sâu, học máy và các hệ thống xử lý thuật toán khác) sử dụng các bộ dữ liệu và thuật toán hỗn hợp để tạo ra nội dung tổng hợp, chẳng hạn như công nghệ deepfake (deepfake là công nghệ sự thao túng diện mạo khuôn mặt thông qua các phương pháp AI). Trong đó có một số quy định chính bao gồm:

- Phải có sự đồng ý từ chính người dùng để hình ảnh của họ được sử dụng trong bất kỳ công nghệ tổng hợp sâu nào.

- Không được dùng dịch vụ tổng hợp sâu để phát tán tin giả.

- Để dùng được dịch vụ deepfake, người dùng cần xác thực danh tính thực sự.

- Nội dung tổng hợp được tạo ra bằng AI phải có loại thông báo nào đó để thông báo cho người dùng rằng hình ảnh hoặc video đã được tạo ra hay thay đổi bằng công nghệ trí tuệ nhân tạo AI.

- Nội dung đi ngược lại luật pháp hiện hành, cũng như nội dung gây nguy hiểm cho an ninh và lợi ích quốc gia, làm tổn hại hình ảnh quốc gia hoặc phá hoại nền kinh tế đều bị nghiêm cấm.

C) Quy định về quản lý tổng hợp chuyên sâu các dịch vụ thông tin Internet

Vào ngày 10 tháng 1 năm 2023 "Quy định về quản lý tổng hợp chuyên sâu các dịch vụ thông tin Internet" của Cục quản lý không gian mạng Trung Quốc có hiệu lực. Trong đó điều luật có hiệu lực đối với “việc sử dụng công nghệ trí tuệ nhân tạo tổng hợp để cung cấp các dịch vụ tạo ra văn bản, hình ảnh, âm thanh, video và các nội dung khác cho công chúng trên lãnh thổ Cộng hòa Nhân dân Trung Hoa (sau đây gọi là dịch vụ trí tuệ nhân tạo tổng hợp).” (điều 2)

Trong đó có một số quy định chính cần phải để ý bao gồm:

- Việc cung cấp và sử dụng dịch vụ trí tuệ nhân tạo sáng tạo phải tuân thủ pháp luật và các quy định phát luật hiện hành, tôn trọng đạo đức xã hội được quy định trong pháp luật trung quốc.

- Nhà cung cấp dịch vụ trí tuệ nhân tạo sáng tạo phải thực hiện đào tạo xử lý dữ liệu theo quy định của pháp luật bao gồm viêc sử dụng dữ liệu từ các nguồn hợp pháp, không vi phạm các điều luật trong đạo luật trí tuệ của Trung Quốc và cần phải có sự đồng ý của người dùng nếu thu nhập hoặc sử dụng thông tin riêng của họ

- Nếu nhà cung cấp dịch vụ trí tuệ nhân tạo phát hiện nội dung vi phạm pháp luật thì phải kịp thời thực hiện các biện pháp xử lý như ngừng tạo, dừng truyền, loại bỏ, đồng thời thực hiện các biện pháp như đào tạo tối ưu hóa mô hình để khắc phục sau đó báo cáo cho cơ quan có thẩm quyền liên quan.

- Ngoài ra luật này còn bao gồm các điều khoản khuyến khích sự hợp tác giữa các bên liên quan trong chuỗi cung ứng trí tuệ nhân tạo AI.

2.2.2 Tổng quan về pháp luật của Trung Quốc đối với AI

Trung Quốc đã và đang điều chỉnh luật pháp cho từng ứng dụng AI cụ thể (tức là thuật toán đề xuất internet, công nghệ tổng hợp sâu và Trí tuệ nhân tạo tạo sinh) thay vì tạo ra một quy định AI toàn diện (như Dự luật AI của EU). Điều này cho phép Trung Quốc nhắm tới việc xử lý và tạo ra các quy tắc tùy chỉnh nhắm vào các vấn đề cụ thể có thể xảy ra đối với trí tuệ nhân tạo AI. Đồng thời xây dựng đều đặn các công cụ chính sách và bí quyết quản lý với quy định mới.

Luật AI hiện tại của Trung Quốc có ba điểm tương đồng về cấu trúc:

Lựa chọn quản lý thuật toán làm điểm đầu vào: Luật này tập trung vào việc quản lý thuật toán, đặt nền tảng cho việc kiểm soát và giám sát các ứng dụng trí tuệ nhân tạo (AI).

Xây dựng các công cụ quản lý và bí quyết hành chính: Luật AI của Trung Quốc nhấn mạnh việc xây dựng các công cụ quản lý và quy trình hành chính, giúp thúc đẩy việc thực thi và tuân thủ luật pháp trong lĩnh vực AI.

Cách tiếp cận gắt gao, lặp đi lặp lại của các thủ tục hành chính với từng ứng dụng trí tuệ nhân tạo AI: Luật AI của Trung Quốc đặt nền tảng cho việc áp dụng các quy định cụ thể cho từng loại ứng dụng trí tuệ nhân tạo, nhắm đến việc tạo ra một cấu trúc pháp lý cơ bản cho lĩnh vực này.

Tuy nhiên, hiện nay các quy định của Trung Quốc vẫn có phạm vi áp dụng khá hẹp, tập trung chủ yếu vào các công ty lớn và chỉ yêu cầu đánh giá bảo mật dựa trên nội dung đối với những người có ảnh hưởng đến dư luận. Điều này tạo điều kiện cho các công ty phát triển trí tuệ nhân tạo khác của nước này, nhưng cũng có thể làm giảm tác động của luật pháp đối với các tổ chức và cá nhân nhỏ hơn trong lĩnh vực này.

2.2.3. Kế hoạch tương lai của nước Trung Quốc đối với AI.

Hiện nay các nhà lập pháp Trung Quốc đang ở trong quá trình soạn thảo luật pháp để quy định AI một cách toàn diện. Theo như chiến lược sắp tới của Trung Quốc đối với AI, Trung Quốc muốn đẩy mạnh và tiến tới việc thúc đẩy, phát triển trí tuệ nhân tạo AI đồng thời điều phối việc tiêu chuẩn hóa AI và xây dựng hệ thống tiêu chuẩn đáp ứng nhu cầu phát triển của ngành AI.

Như vậy, Trung Quốc không chỉ muốn tăng cường sức mạnh của công nghệ trí tuệ nhân tạo AI của họ mà còn quan tâm đến việc đảm bảo rằng việc sử dụng AI được điều chỉnh và kiểm soát một cách hợp lý thông qua việc thiết lập các quy định pháp lý và tiêu chuẩn chất lượng

2.2.4 Tổng quan về pháp luật của Singapore đối với AI

Singapore nổi tiếng là thị trường thân thiện dành cho các doanh nghiệp toàn cầu do các chính sách thu hút nhân tài và đầu tư từ mọi nơi trên thế giới. Vì vậy, các chính sách của Singapore thường rất thiết thực trong việc trao quyền cho sự đổi mới và tự do của doanh nghiệp một cách hợp lý nhất có thể. Các nhà làm luật thường tập trung vào việc phát hành các bộ công cụ và khuôn khổ thực tế về trí tuệ nhân tạo AI để các doanh nghiệp có thể dễ dàng triển khai và hoạt động 1 cách nhanh chóng.

Hiện nay theo chiến lược về AI của bộ thông tin và truyền thông của Singapore ra mắt vào ngày 4 tháng 12 năm 2023. Singapore sẽ tiếp tục mở rộng hơn với việc nghiên cứu và phát triển các dự án về việc ứng dụng AI trong đời sống người dân với nhiều chiến lược thu hút các nhà đầu tư bao gồm hỗ trợ cho các doanh nghiệp đối với nhu cầu sử dụng dữ liệu có ích cho việc chế tạo AI, cung cấp nguồn lực để cho các doanh nghiệp nhanh chóng ứng dụng và đào tạo các nguồn nhân lực thuộc công nghệ trí tuệ nhân tạo AI

2.3 Sơ lược về phương pháp tiếp cận, ứng dụng và quản lý của Singapore đối với các ứng dụng AI

Tổ chức xác minh AI- AI Verify.

Vào năm 2019, Singapore công bố việc ra mắt khung mô hình Quản trị AI đầu tiên trên thế giới. Tiếp nối với thành công này vào 2022 chính phủ Singapore ra mắt AI Verify, một giải pháp quản trị AI với quy định về môi trường thử nghiệm và bộ công cụ phần mềm để xây dựng AI . Mô hình bao gồm những nguyên tắc đạo đức AI phù hợp với khuôn khổ pháp luật của Singapore nhằm giúp các tổ chức xác nhận hiệu suất của hệ thống AI của họ dựa trên các nguyên tắc này thông qua các bài kiểm tra

OneService Chatbot

Ra mắt bởi văn phòng Dịch vụ Đô thị và Cơ quan Công nghệ Chính phủ (GovTech). Công nghệ được phát triển bởi trí tuệ nhân tạo cho phép công dân gửi khiếu nại và cung cấp thông tin thông qua các ứng dụng nhắn tin xã hội thường được sử dụng. chatbot có thể tự động xác định và phân loại các khiếu nại thành các nhóm loại thích hợp, tự đồng trích xuất các chi tiết liên quan của những sự cố cần quan tâm và thông báo cho cơ quan Chính phủ liên quan.

Mục tiêu của công nghệ này là tạo điều kiện thuận lợi cho người dân trong việc gửi phản hồi và khiếu nại tới các cơ quan chính quyền thành phố mà không cần phải tìm hiểu phức tạp về các bộ phận liên quan. Đồng thời, nó cũng giúp cơ quan có thẩm quyền tham gia vào giải quyết các vấn đề và sự cố nhanh chóng hơn, từ đó nâng cao sự minh bạch và hiệu quả của hệ thống quản lý công việc chính phủ.

Hướng dẫn sử dụng dữ liệu cá nhân trong AI

Vào ngày 1 tháng 3 năm 2024, Uỷ ban bảo vệ cá nhân của Singapore xuất bản hướng dẫn sử dụng dữ liệu cá nhân trong việc đào tạo và phát triển các sản phẩm trí tuệ nhân tạo AI. Trong đó bao gồm các hướng dẫn chi tiết cụ thể để giúp cho các doanh nghiệp áp dụng trí tuệ nhân tạo AI vào mô hình doanh nghiệp. Ngoài ra bảng hướng dẫn cũng đưa ra các khuyến cáo và kiến nghị yêu cầu các doanh nghiệp đảm bảo thông tin thu nhập được phù hợp với pháp luật đã định của Singapore và thông báo cho người dùng biết được mục đích sử dụng thông tin cá nhân của họ, thể hiện góc nhìn của chính phủ trong việc khuyến khích các doanh nghiệp cung cấp công nghệ trí tuệ nhân tạo xây dựng và phát triển mô hình không xâm phạm đến quyền con người và pháp luật của đất nước Singapore.

2.3.1 Phân tích các quy định liên quan đến việc đánh giá AI của tổ chức AI Verify của Singapore

Hiện nay tổ chức AI Verify có 2 phương pháp để đánh giá công nghệ trí tuệ AI của các công ty chia làm 2 loại là hệ thống trí tuệ nhân tạo mô hình ngôn ngữ lớn (LLM) và hệ thông trí tuệ nhân tạo tạo sinh (Generative AI). Hiện nay phương pháp đánh giá hệ thống trí tuệ nhân tạo lớn đã được hoàn thành tuy nhiên hệ thống đánh giá trí tuệ nhân tạo tạo sinh (Generative AI) vẫn đang trong quá trình xây dựng

2.3.2. Hệ thống trí tuệ nhân tạo mô hình ngôn ngữ lớn (LLM) và mô hình đánh giá hệ thống.

Mô hình ngôn ngữ lớn (LLM) là mô hình trí tuệ nhân tạo AI được thiết kế với mục đích và yêu cầu đối với khả năng xử lý, hiểu và tạo ra văn bản, ngôn ngữ tự nhiên giống như con người. Chúng được xây dựng dựa trên cơ sở thông tin kiến thức và thường được huấn luyện trên lượng lớn dữ liệu như sách, trang web, bài báo cáo, ….

Mô hình ngôn ngữ lớn AI cho phép AI nắm bắt cú pháp, ngữ nghĩa, cấu trúc ngôn từ. Thậm chí một số khía cạnh của kiến thức chung để xử lý và tạo ra văn bản. Mô hình không chỉ có khả năng sinh ra văn bản tự nhiên. Mà còn có thể được ứng dụng trong nhiều lĩnh vực như xử lý ngôn ngữ, trả lời câu hỏi, dịch thuật, tóm tắt văn bản và tạo ra nội dung tự động.

Theo đó tổ chức AI Verify sẽ có 3 phương pháp đánh điểm để đánh giá LLM bao gồm :

Đo điểm chuẩn: Đo lường qua việc sử dụng các bộ dữ liệu câu hỏi để đánh giá một LLM dựa trên kết quả đầu ra của chúng. Nó có thể được so sánh với sự thật hoặc so sánh theo một số quy tắc đã được xác định trước.

Lập nhóm tự động: AI verify sẽ sử dụng một mô hình khác để khởi tạo các đề xuất và thăm dò một LLM để đạt được kết quả mục tiêu cho đánh giá (ví dụ: Đánh giá các biến thể của các đề xuất có dẫn đến việc sản xuất các kết quả độc hại hay không).

Lập nhóm thủ công: Phương pháp này sử dụng tương tác của con người để khởi tạo các đề xuất và thăm dò một LLM để đạt được kết quả mục tiêu cho việc đánh giá

Cách chấm điểm cho một mô hình trí tuệ nhân tạo của AI Verify

Chấm điểm bằng các thuật toán: Trong đây AI verify sẽ sử dụng các thuật toán để chấm điểm cho các kết quả do mô hình AI tạo ra. Trong đó cũng bao gồm các việc đánh điểm số dựa trên các quy tắc như sự giống nhau, sự trôi chảy và sự phù hợp của các kết quả được tạo ra từ mô hình.

Chấm điểm bằng con người: Người dùng được yêu cầu đánh giá về tính liên quan, tính liên kết hoặc các khía cạnh chất lượng khác của những sản phẩm đầu ra từ LLM.

Chấm điểm mô hình : Phương pháp này sử dụng một mô hình trí tuệ nhân tạo bất kì khác để so sánh và đánh giá chất lượng của mô hình AI và sản phẩm do mô hình AI tạo ra.

Phân tích sâu hơn về các tiêu chí chấm điểm của AI Verify.

Tổ chức AI verify phân loại việc đánh giá công nghệ trí tuệ nhân tạo AI với các mô hình ngôn ngữ lớn LLM dựa theo 5 tiêu chí:

- Năng lực chung

- Khả năng cụ thể của AI trong từng lĩnh vực

- Độ an toàn và tin cậy

- Rủi ro

- Trường hợp sử dụng không mong muốn

Phân tích về khả năng của từng tiêu chí

- Năng lực chung: Ý tưởng cốt lõi của tiêu chí này việc mô hình khả năng làm được những gì, làm tốt như thế nào ? trong hoàn cảnh nào nó sẽ hoạt động một cách tốt nhất ? Trong đó tổ chức AI verify sẽ dựa vào 7 chỉ tiêu để đánh giá năng lực chung của mô hình AI dựa theo sản phẩm của mô hình AI bao gồm

- Khả năng am hiểu ngôn ngữ tự nhiên của mô hình AI

- Khả năng sáng tạo ra sản phẩm được viết bằng ngôn ngữ tự nhiên

- Lý luân của sản phẩm do mô hình AI tạo ra

- Kiến thức và thực tế

- Hiệu quả sử dụng công cụ

- Khả năng hiểu và sử dụng đa ngôn ngữ của mô hình AI

- Đánh giá mức độ mô hình AI phản ứng với các bối cảnh

- Khả năng cụ thể của từng lĩnh vực

Các phương pháp này được thiết kế để đo lường hiệu suất của các LLM trong ngữ cảnh cụ thể của một ngành công nghiệp hoặc lĩnh vực nhất định như y học hoặc luật. Chúng đóng vai trò như các công cụ cần thiết trong việc đánh giá xem một mô hình AI (LLM) có thể đáp ứng được các yêu cầu nghiêm ngặt của chuyên ngành hay không.

- Độ an toàn và tin cậy: Danh mục này đánh giá dựa trên độ tin cậy trong hoạt động của một mô hình AI (LLM) và những rủi ro tự nhiên của nó. Điều này bao gồm khả năng tránh việc sản xuất ra được những sản phẩm có hại hoặc mang thiên chế thiên vị bằng việc thao tác với trí tuệ nhân tạo với thông tin đầu vào lớn. Các phân loại của nó bao gồm.

- Khả năng tạo ra các thông tin độc hại

- Thiên chế thiên vị của mô hình trí tuệ nhân tạo AI

- Hiệu suất của mô hình trí tuệ nhân tạo AI khi đối mặt với các thông tin độc hại, chưa chuẩn bị trước

- Khả năng phân biệt giữa hành động đạo đức và vô đạo đức của công nghệ trí tuệ nhân tạo và lý do khiến mô hình AI không phân biệt được.

- Đánh giá mức độ tái tạo dữ liệu của mô hình AI khi được huấn luyện và liệu trong quá trình sử dụng các mô hình AI có khả năng "rò rỉ" các thông tin nhạy cảm đã được cung cấp cho chúng hay không

- Rủi ro: Hạng mục này đánh giá các thảm họa tiềm ẩn và hậu quả có thể phát sinh từ công nghệ trí tuệ nhân tạo.

- Trường hợp sử dụng không mong muốn: Phân tích và đánh giá mô hình AI để xác định xem liệu mô hình AI có thể được sử dụng cho các mục đích độc hại hoặc trái với pháp luật, đạo đức hay không.

2.3.3. Hệ thống đánh giá trí tuệ nhân tạo tạo sinh (Generative AI) và định hướng phát triển của nước Singapore đối với AI.

Trí tuệ nhân tạo tạo sinh (AI tạo sinh) là một dạng AI có khả năng tạo ra nội dung và ý tưởng mới, bao gồm các cuộc trò chuyện, câu chuyện, hình ảnh, video và âm nhạc dựa trên các mẫu và ví dụ mà chúng đã được huấn luyện.

Trí tuệ nhân tạo tạo sinh (Generative AI) là một lĩnh vực toàn diện bao gồm một loạt các hệ thống trí tuệ nhân tạo dành riêng cho việc tạo ra nội dung mới và sáng tạo, bao gồm văn bản, hình ảnh, âm nhạc và mã nguồn. Trái ngược với điều đó, các mô hình ngôn ngữ lớn (LLMs) chỉ đại diện cho một loại cụ thể của các mô hình trí tuệ nhân tạo sinh học với sự tập trung chuyên sâu vào việc chuyển hóa dữ liệu dựa trên văn bản đã được cung cấp.

Hiện nay do trí tuệ nhân tạo tạo sinh còn rất mới cho nên tổ chức AI Verify của Singapore chưa công bố văn bản chính thức để điều chỉnh nào, thay vào đó tổ chức AI Verify đã công bố kế hoạch để tạo ra một hệ sinh thái để quản lý, phát triển và bảo vệ đối với công nghệ AI này

Mô hình dự kiến hệ sinh thái AI của AI Verify

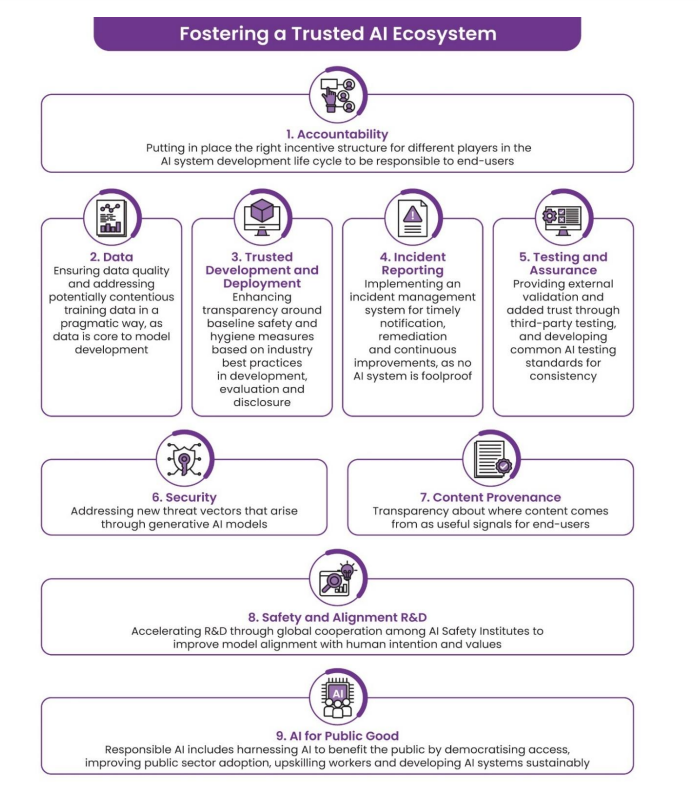

Trong đó hệ sinh thái AI verify sẽ có các mục tiêu đặc biệt lưu ý :

- Trách nhiệm: Khuyến khích các bên trong chuỗi phát triển trí tuệ nhân tạo phải chịu trách nhiệm đối với người dùng khi họ sử dụng công nghệ AI .Trách nhiệm có thể được phân bổ dựa trên mức độ kiểm soát của mỗi bên liên quan trong chuỗi phát triển trí tuệ nhân tạo trong đó các bên liên quan thực hiện các biện pháp cần thiết để bảo vệ người dùng khi họ sử dụng mô hình AI được cung cấp.

- Dữ liệu : Do dữ liệu là một yếu tố cốt lõi của quá trình phát triển mô hình. Do đó, việc đảm bảo chất lượng dữ liệu được cung cấp cho mô hình AI là rất quan trọng. Ví dụ như việc có nhiều trường hợp sử dụng dữ liệu cho việc huấn luyện mô hình đã gây ra tranh cãi, chẳng hạn như việc dữ liệu cá nhân và tài liệu bản quyền được sử dụng để đào tạo AI. Vì vậy tổ chức AI Verify phải đảm bảo việc xử lý dữ liệu là công bằng và thực tế.

- Sự tin cậy trong việc triển khai và phát triển mô hình AI: Việc quản lý một cách minh bạch về các biện pháp cơ bản về an toàn và thực hiện sẽ là điểm cần chú ý. Điều này yêu cầu sự cân nhắc một cách hợp lý với các yếu tố như bảo vệ các thông tin tuyệt mật, ngăn chặn các hành động không đạo đức làm ảnh hưởng đến hệ thống.

- Báo cáo các sự cố liên quan đến mô hình AI: Hệ sinh thái yêu cầu việc thiết lập cấu trúc và quy trình để báo cáo sự cố. Điều này hỗ trợ việc cải tiến liên tục của các hệ thống trí tuệ nhân tạo thông qua những thông tin chi tiết qua các biện pháp khắc phục và xử lý lỗi.

- Kiểm tra và bảo đảm: đóng vai trò bổ sung để quản lý và kiểm tra sự tin cậy của hệ thống AI nói riêng và hệ sinh thái nói chung. Cung cấp thông tin minh bạch đi kèm với việc xây dựng sự uy tín và niềm tin cho người dùng sản phẩm AI.

- Sự bảo mật: Hệ sinh thái yêu cầu một mô hình thiết kế dành riêng cho AI để đảm bảo bảo mật. Mô hình đóng vai trò giảm thiểu các lỗ hổng hệ thống và giảm rủi ro tấn công bằng cách thiết kế bảo mật vào mọi giai đoạn của vòng đời phát triển hệ thống trí tuệ nhân tạo. Trong đó các mô hình bao gồm việc phát triển, đánh giá, vận hành và bảo trì công nghệ trí tuệ nhân tạo AI.

- Nguồn gốc nội dung : Hiện nay bắt kịp tốc độ và quy mô của nội dung được tạo ra bởi trí tuệ nhân tạo tổ chức AI Verify sẽ tập trung vào một số các giải pháp kỹ thuật, như đánh dấu số và và tạo mã nguồn mật mã. Việc này nhằm đánh dấu và cung cấp thông tin bổ sung để thông báo cho người dùng biết các nội dung được tạo ra hoặc sửa đổi bởi trí tuệ nhân tạo.

- Sự an toàn và đồng bộ của hệ thống: Với sự phát triển của hệ thống AI, mô hình cần đảm bảo rằng sự phát triển của AI phù hợp với khả năng của con người trong việc điều chỉnh và kiểm soát sự phát triển của trí tuệ nhân tạo cùng với việc quản lý các rủi ro tiềm ẩn, thảm họa.

- Trí tuệ nhân tạo vì lợi ích của cộng đồng: Hệ sinh thái đề cao lợi ích cộng đồng thông qua công nghệ trí tuệ nhân tạo AI . Với mục tiêu là tăng tốc tăng trưởng và năng suất, đồng thời tạo điều kiện cho việc tăng cường sức mạnh cho đất nước và doanh nghiệp của Singapore.

2.3.4 Kế hoạch tương lai của nước Singapore đối với AI

Theo như chiến lược của Singapore đối với AI, Singapore có một góc nhìn tốt hơn đối với việc phát triển đất nước để đi theo con đường phát triển thuận lợi cho AI với chính sách khác biệt so với các nước khác. Tuy Singapore chưa thực thi quy định cụ thể về AI nhưng đã phát triển các bộ công cụ và khuôn khổ thực tế để quản lý và đảm bảo an toàn cho AI ở một số phạm trù nhất định

Cách tiếp cận này phản ánh sự linh hoạt và thân thiện với doanh nghiệp, giúp tạo điều kiện cho sự phát triển và ứng dụng của AI trong các lĩnh vực khác nhau. Bằng cách tạo ra một môi trường chính sách thúc đẩy sự sáng tạo và đổi mới trong lĩnh vực AI, Singapore đang đặt mình vào vị thế đáng chú ý trong cuộc đua công nghệ toàn cầu.

Đặc biệt, việc tập trung vào thực tiễn và sự linh hoạt trong việc áp dụng chính sách đã giúp Singapore thu hút sự quan tâm của các doanh nghiệp và nhà đầu tư, từ đó tạo điều kiện cho sự phát triển bền vững của ngành công nghiệp AI trong nước.

Chương 3: Trí tuệ nhân tạo ở Việt Nam, thực trạng và phương hướng toàn diện

3.1. Trí tuệ nhân tạo ở Việt Nam.

Tại Việt Nam, mặc dù AI đã bắt đầu được phát triển và ứng dụng trong nhiều lĩnh vực khác nhau và được xem như một động lực quan trọng cho định hướng phát triển kinh tế - xã hội. Tuy nhiên, cũng tương tự như nhiều nước, ngoài những chính sách phát triển AI, hệ thống pháp lý tại Việt Nam vẫn chưa tiếp cận rõ ràng tới AI . Hay nói cách khác, chưa có quy định cụ thể xác định tư cách pháp lý của AI khi tham gia vào các quan hệ xã hội được pháp luật điều chỉnh. Ví dụ như pháp luật dân sự ở Việt Nam chỉ có quy định chủ thể phải là cá nhân hoặc tổ chức (BLDS 2015), chưa ghi nhận dạng chủ thể là máy móc hay chương trình máy tính, do vậy sẽ là không thể nếu xác định tư cách pháp lý của AI là những chủ thể trong pháp luật.

Ngoài ra hoạt động lập pháp vẫn còn có những hạn chế nhất định, như việc thường xuyên điều chỉnh chương trình xây dựng luật pháp lệnh; chất lượng các đạo luật chưa cao, đặc biệt là các quy phạm chính trị còn tồn tại khá phổ biến trong các đạo luật; kỷ cương lập pháp chưa nghiêm, trách nhiệm của người đứng đầu chưa xác định rõ…

Tuy nhiên Việt Nam cũng đã có rất nhiều động thái để chuẩn bị cho sự đổi mới và phát triển này bao gồm:

- Năm 2020, Thủ tướng Chính phủ ký Quyết định số 2117/QĐ-TTg, ban hành danh mục công nghệ ưu tiên nghiên cứu, phát triển và ứng dụng để chủ động tham gia cuộc Cách mạng công nghiệp lần thứ tư. Ở lĩnh vực công nghệ số, danh mục công nghệ ưu tiên gồm: Trí tuệ nhân tạo; Internet vạn vật; công nghệ phân tích dữ liệu lớn; công nghệ chuỗi khối; điện toán đám mây… Trong số đó, Bộ Khoa học và Công nghệ xác định AI là công nghệ được ưu tiên hàng đầu

- Đầu năm 2021, Thủ tướng Chính phủ ban hành Quyết định số 127/QĐ-TTg, ngày 26-1-2021, “Về Chiến lược Quốc gia về nghiên cứu, phát triển và ứng dụng trí tuệ nhân tạo đến năm 2030”. Chiến lược này đưa ra mục tiêu cụ thể nhằm đẩy mạnh nghiên cứu, phát triển và ứng dụng, đưa trí tuệ nhân tạo trở thành lĩnh vực công nghệ quan trọng của Việt Nam trong Cuộc cách mạng công nghiệp lần thứ tư.

- Năm 2023, hàng loạt doanh nghiệp công nghệ lớn của Việt Nam, như Viettel, FPT, Rikkei Soft... bắt đầu có sự đầu tư rất lớn cho việc nghiên cứu, phát triển, ứng dụng trí tuệ nhân tạo trong tương lai. Theo đó, Tập đoàn Viettel đang tập trung nghiên cứu phát triển AI với 3 lĩnh vực chính: Xử lý tiếng nói và ngôn ngữ tự nhiên, thị giác máy tính và phân tích dữ liệu. Ngoài ra, Viettel đang phát triển thêm lĩnh vực robotics và digital twin để mở rộng lĩnh vực AI. Trong khi đó, Tập đoàn FPT đang ứng dụng công nghệ AI trong rất nhiều lĩnh vực, từ chăm sóc sức khỏe, đến giáo dục và giải quyết thủ tục hành chính.

3.2. Chiến lược của Việt Nam đối với việc nghiên cứu, phát triển và ứng dụng trí tuệ nhân tạo.

Đầu năm 2021, Thủ tướng Chính phủ ban hành Quyết định số 127/QĐ-TTg, ngày 26-1-2021, “Về Chiến lược Quốc gia về nghiên cứu, phát triển và ứng dụng trí tuệ nhân tạo đến năm 2030”. Chiến lược này bao gồm:

- Xây dựng và hoàn thiện bổ sung các văn bản pháp luật về giao dịch điện tử đồng thời thiết lập mô hình quản lý và chia sẻ dữ liệu về các khung thể chế thử nghiệm sandbox cho trí tuệ nhân tạo

- Hình thành nền tảng dữ liệu và tính toán phục vụ cho việc phát triển trí tuệ nhân tạo AI.

- Khuyến khích hình thành các tổ chức triển khai đào tạo ngắn hạn cho đội ngũ cán bộ nghiên cứu, kĩ thuật và quản lý để đáp ứng yêu cầu nghiên cứu và phát triển sản phẩm trí tuệ nhân tạo trong doanh nghiệp

- Hình thành các doanh nghiệp cung cấp các giải pháp tích cực dựa trên công nghệ trí tuệ nhân tạo

- - Thúc đẩy phát triển và triển khai các ứng dụng trí tuệ nhân tạo trong lĩnh vực đảm bảo an toàn dữ liệu, an toàn an minh mạng. quản lý đô thi, xã hội và hành chính công

- Triển khai các chương trình tuyên truyền, nâng cao nhận thức của người dân, cán bộ, công chức, doanh nghiệp, vè học sinh về dữ liệu và việc ứng dụng trí tuệ nhân tạo trong đời sống

- Triển khai việc phát triển của các cơ quan chính quyền Việt Nam, chuẩn bị cho sự phát triển về công nghệ trí tuệ nhân tạo trong tương lai.

3.3 Bài học có được từ việc quan sát cách tiếp cận của các nước khác đối với việc quản lý AI

Hiện nay pháp luật nước ta đang tập trung vào việc phát triển các cơ sở hạ tầng và nguồn nhân lực để đẩy mạnh việc phát triển trí tuệ nhân tạo AI. Tuy chưa có quy định cụ thể về AI, nhưng nước ta đã có công nhận về sự tồn tại của AI qua chiến lược quốc gia qua Quyết định số 127/QĐ-TTg, ngày 26-1-2021, “Về Chiến lược Quốc gia về nghiên cứu, phát triển và ứng dụng trí tuệ nhân tạo đến năm 2030” . Mặc dù vậy việc phát triển hành lang pháp lý cho AI vẫn chưa được coi là đầy đủ.

Tuy vậy nhìn vào sự tiếp cận của các nước khác đối với pháp luật cho công nghệ trí tuệ nhân tạo AI ta có thẻ rút ra một số bài học cho hành lang pháp lý trong tương lai bao gồm:

Liên minh EU:

Sự tiếp cận của liên minh EU đối với việc phân loại và quy định đến các mô hình trí tuệ nhân tạo AI dựa theo tỉ lệ rủi ro

Sự tiếp cận và quản lý mô hình một cách chặt chẽ, đảm bảo cho việc mô hình trí tuệ nhân tạo phát triển phù hợp với mục tiêu và giá trị của liên minh EU

Các điều khoản đẩy nhanh việc lưu truyền thông tin, đảm bảo cho sự an toàn và chắc chắn của mô hình bằng các quy định yêu cầu về giấy tờ kĩ thuật đối với mô hình trí tuệ nhân tạo ở EU

Các điều luật đảm bảo cho sự tương tác của con người để giảm thiểu những rủi ro có thể tạo ra từ AI

Singapore:

Đối với Singapore, tuy hiện nay Singapore vẫn chưa có luật cụ thể quy định về AI. Tuy nhiên Singapore đã có rất nhiều động thái để hỗ trợ cho sự phát triển cho các doanh nghiệp cung cấp và phát triển dịch vụ trí tuệ nhân tạo như cung cấp thông tin cho sự phát triển của AI, tăng cường bổ sung và đầu tư vào việc ứng dụng một số bộ máy chính quyền vào AI như chatbox của chính phủ, mô hình test AI khuyến khích các công ty cung cấp dịch vụ AI chế tạo và phát triển theo các quy định của Singapore qua mô hình hệ sinh thái AI Verify.

Trung Quốc:

Trung Quốc với mô hình quản lý chặt chẽ về pháp luật giữa các lĩnh vực cụ thể cho phép Trung Quốc nhắm vào việc xử lý và tạo ra các quy tắc tùy chỉnh nhắm vào các vấn đề cụ thể đối với công nghệ trí tuệ nhân tạo AI.

Mặc dù hiện nay luật pháp Trung Quốc của AI về công nghệ trí tuệ nhân tạo AI còn rất lỏng. Trung Quốc cũng đã có rất nhiều động thái để đảm bảo cho việc phát triển phù hợp với mô hình nhà nước. Ví dụ như việc luật AI hiện hành của Trung Quốc tập trung đặc biệt vào việc đảm bảo rằng hệ thống AI không được sử dụng để “gây nguy hiểm cho an ninh quốc gia hoặc lợi ích công cộng xã hội”.